Studentische Beiträge, die KI-Themen oder Creative Technology aufgreifen.

KI und Creative Technology im Informationsmanagement und -design

Studentische Beiträge, die KI-Themen oder Creative Technology aufgreifen.

Studentische Beiträge, die KI-Themen oder Creative Technology aufgreifen.

Autorin: Smilla Kolbe

Der Begriff „Dritter Ort“ wurde von Ray Oldenburg geprägt und beschreibt Orte, die als Ausgleich zu Familie und Beruf dienen. Aus einer amerikanischen Perspektive schaut Oldenburg sehnsüchtig nach Europa – Hier gibt es Pubs, Kaffeehäuser und Biergärten. Aber was ist eigentlich mit Bibliotheken?

The wonder is that so little attention has been paid to the benefits attaching to the third place. It is curious that its features and inner workings have remained virtually undescribed in this present age when they are so sorely needed and when any number of lesser substitutes are described in tiresome detail. Volumes are written on sensitivity and encounter groups, on meditation and exotic rituals for attaining states of relaxation and transcendence, on jogging and massaging. But the third place, the people’s own remedy for stress, loneliness, and alienation, seems easy to ignore.

– Ray Oldenburg, the great good place

Um die Frage zu beantworten, ist es zunächst wichtig, die Eigenschaften des ersten und zweiten Ortes zu definieren. Der erste Ort beschreibt das Zuhause – ein persönlicher Rückzugsort, in dem die engsten Beziehungen gepflegt werden. Es handelt sich dabei um einen informellen Raum, der zugleich Schutz und Geborgenheit bietet, jedoch auch isolierend wirken kann. Der zweite Ort hingegen steht für das berufliche oder akademische Umfeld. Dieser Raum ist geprägt von Produktivität, Verantwortung und klaren Strukturen. Hier zählt weniger die individuelle Persönlichkeit als vielmehr die Erfüllung von Pflichten und die eigene Leistungsfähigkeit. Dritte Orte unterscheiden sich grundlegend von diesen beiden: Dritte Orte sind Räume der Gemeinschaft, in dem Menschen ungezwungen zusammenkommen können. Gesellschaftliche Merkmale wie Status oder Herkunft spielen hier keine Rolle und werden symbolisch an der Eingangstür abgelegt – ähnlich wie ein Mantel an der Garderobe eines Theaters oder Clubs. Diese neutrale Atmosphäre schafft die Grundlage für ein soziales Miteinander, das frei von äußeren Zuschreibungen ist.

Während meines Studiums bin ich auf das Konzept der „Dritten Orte“ gestoßen und war sofort fasziniert von ihrer Bedeutung für unsere Gesellschaft. Besonders Bibliotheken als dritte Orte haben mich angesprochen, da sie nicht nur Räume des Wissens, sondern auch der Begegnung und des Austauschs sind. In einer Zeit, in der Technologienutzung oft den direkten Kontakt mit Menschen ersetzt, halte ich solche Orte für unverzichtbar. Sie bieten die Möglichkeit, echte Gemeinschaft zu erleben und fördern das persönliche Wachstum, das nur durch zwischenmenschliche Interaktionen entstehen kann. Das Konzept der dritten Orte geht auf Ray Oldenburg (7. April 1932 – 21. November 2022) zurück. Oldenburg war ein amerikanischer Soziologe, der die Bedeutung informeller öffentlicher Treffpunkte für eine funktionierende Zivilgesellschaft, Demokratie und bürgerschaftliches Engagement betonte. Er prägte den Begriff des „Third Place“ (Dritter Ort) und schrieb das Buch The Great Good Place, das 1989 von der New York Times Book Review als Editor’s Choice ausgezeichnet wurde. 2001 veröffentlichte er zudem Celebrating The Third Place, das die Rolle und Bedeutung dritter Orte weiter vertieft.

Um dies genauer zu beleuchten, habe ich mir fachnahe Unterstützung geholt. Ich hatte die Gelegenheit, mit Herrn Michael Stünkel, dem Leiter der Zentralbibliothek Hannover, zu sprechen. Herr Stünkel arbeitet seit 1999 in der Stadtbibliothek Hannover und konnte gute Einblicke in die Transformation der öffentlichen Bibliotheken zu einem „Dritten Ort“ geben. Möchtest du das Interview lesen oder erstmal herausfinden, was dein Dritter Ort ist?

© Zentralbibliothek Hannover

Betritt man die Zentralbibliothek Hannover, sieht man hier und da Menschen, die Zeitung lesen und Kaffee trinken. Man hört die Schüler, die ihre Hausaufgaben erledigen. All das erstreckt sich über fünf Etagen, die durch eine innenliegende Treppe miteinander verbunden sind. Die Zentralbibliothek Hannover ist offen und lebendig.

Bibliotheken umzugestalten bzw. anders zu führen bringt mehr Arbeit mit sich – das Büro von Herrn Stünkel ist chaotisch. Bücher und Papier stapeln sich. Das war nicht immer so, sagt Stünkel. Wandel heißt Arbeit.

Michael Stünkel (MS): Ja, Klassisch ist [es] schon fast, ein „Dritter Ort“ zu sein. Ein Treffpunkt zu sein, Austausch zu haben untereinander. Manchmal auch allein in Gemeinschaft sein, also wir beobachten hier viele Menschen die hier einzeln sitzen, aber es genießen, das rundherum auch Menschen einzeln sitzen und so kommt man ins Gespräch. Also der Ort des Treffpunkts, auch der Auseinandersetzung. Es gibt hier viele Veranstaltungsformate, wo diskutiert wird – kontrovers diskutiert wird. [Diese Veranstaltungen] kann man konsumieren, man kann aber auch mitmachen.

MS: Wir machen zu bestimmten Themen Diskussionsveranstaltungen. Literarische Lesungen eher weniger, weil das in Hannover anders abgedeckt ist. Zum Beispiel zum Tag der Demokratie oder zum Tag der Bibliotheken. Wir hatten jetzt das Queere Wohnzimmer für vier Monate mit Workshops Lesungen, Diskussionen und Beratungsterminen rund um das Thema in unserem Haus.

© Zentralbibliothek Hannover

MS: Genau das. Der klassische Ort zwischen Zuhause und Arbeit. Nicht kommerziell, ohne Verzehrzwang, niederschwellig zu benutzen, gute Öffnungszeiten [lacht]. Das ist auch ein Punkt, an dem wir weiter arbeiten. Wir haben jetzt die Öffnungszeiten Anfang des Jahres von 11 Uhr bis 19 Uhr auf 9 Uhr bis 19 Uhr erweitert.

MS: Die werden sehr gut angenommen. Ganz schnell ging das. Wir haben im Januar angefangen, in der Hoffnung, ein bisschen zu üben, bis die Leute das alle mitbekommen haben, dass sie früher kommen können. Es waren aber relativ schnell sehr gute Zahlen.

MS: Ja, da sind wir gerade dabei. Wir haben zum Beispiel das Repair-Café. [Das] ist etwas, was auf uns zugekommen ist und von Ehrenamtlichen, insbesondere von einer Person, [betrieben wird]. Das bedeutete eine gewisse Anlaufzeit und inzwischen läuft es vollkommen ohne uns. Ein wenig organisatorische Arbeit durch den Hausdienst, aber nachdem wir Versicherungsfragen, Datenschutz und solche Sachen geklärt hatten, organisiert sich das selber. [Die Veranstalter des Repair-Café] sind einmal im Monat hier. Das versuchen wir mit anderen Konzepten auch umzusetzen. Zum Beispiel die Methothek, kein ganz schönes Wort [lacht], aber gemeint ist damit, dass Menschen die etwas können zum Thema Coaching, Kommunikationstraining, Selbstoptimierung im positiven Sinne, Bewerbungsgespräche vorbereiten,… andere Menschen bei ihrem Vorhaben unterstützen. Diese Personen kommen zu einem bestimmten Tag und machen eine Coffee-Lecture, also kleine Vorträge, aber auch mit Beteiligung der Teilnehmer. Da wünschen wir uns auch, dass sich das mehr verselbstständigt. Wir organisieren das bisher, wir akquirieren auch die Vortragenden, aber es sieht so aus, als würde das auch eine Eigendynamik bekommen, sodass das Bibliotheksbenutzer für Bibliotheksbenutzer dann anbieten.

MS: Ja genau. Und da gibt es mehrere Sachen, die auf diese Schiene gestellt werden sollen.

MS: Ja, unbedingt. Daran muss man auch bei den Kollegen etwas arbeiten. Aber das ist relativ schnell aufgebaut, dieses Vertrauen, wenn sich bewahrheitet, dass nichts passiert. Also, alle wollen ja was Gutes.

MS: Mehrere Kriterien. Durch die Haushaltssituation, oder überhaupt auch durch nachhaltiges Handeln, was auch zu unseren Leitthemen gehört, haben wir nicht neu gekauft, sondern „upgecycelt“, also vorhandenes Material umgebaut, weiter verwendet. Aber sehr radikal, also man sieht nicht unbedingt, dass das Regalsystem aus den 70er Jahren stammt, sondern es ist so neu gestaltet, dass es gut in die Zeit passt. Dann haben wir festgestellt, dass wir wenig, viel viel weniger Bestand brauchen, als wir oder auch viele andere gedacht haben. Wir haben nach festen bibliothekarischen Kriterien ganz viel Medien ausgesondert und dann Platz geschaffen [für eine einladende Atmosphäre]. Anstatt Bücherregale haben wir jetzt freie Flächen. Wir haben viele Einzelarbeitsplätze und Lernzonen geschaffen. [Wir] sind jetzt dabei, auch diese zu möblieren, Steckdosen nachzurüsten. Das ist in jeder Bibliothek, die nicht aus diesem Jahrzehnt stammt, immer eine offene Stelle, weil man hat damals nicht mit Steckdosen geplant.

MS: Ja, warum auch. Aber es ist ein großes Thema auch für die Kunden hier. Zusätzlich haben wir in einem Partizipationsprozess einerseits intern mit unseren Mitarbeitern aber auch extern mit (Nicht-)Nutzern eine Zukunftswerkstatt durchgeführt. Üblich mit Kritikphase, Utopiephase und abschließender Realisierungsphase. Außerhalb des Hauses auch. Da sollten die Teilnehmer sich die Bibliothek der Zukunft vorstellen. [Es gab] bestimmte Methoden. Einmal mit Lego Serious Play oder auch mit Mood-Boards. Jedenfalls extern moderiert, nicht, dass wir als Korrektur dabei waren. Die Ergebnisse der Zukunftswerkstatt sind auch Kriterien für uns. Wir versuchen, die Vorstellung einer Bibliothek der Zukunft unserer Mitarbeiter, aber auch der Kunden und Nicht-Kunden, umzusetzen.

MS: Ja, das war sogar auch oft Rechtfertigung oder Auslöser für bestimmte Sachen, die wir gemacht haben.

MS: Also einmal sieht man, dass das Haus voll ist. So verkehrt kann es also nicht gewesen sein [lacht]. Es gibt viel positive Resonanz zur Reduzierung der Medien, einerseits, natürlich gibt es aber da auch große Kritik.

MS: Also, das Aussondern von Büchern ist für manche Menschen einfach ein Tabu. Und das muss man natürlich auch aushalten. Und es ist auch kein demokratischer Abstimmungsprozess. Wer sich positiv oder negativ äußert, das ist nicht in Zahlen zu messen, sondern es sind nur die Menschen, die sich eben äußern. Was daraus resultiert ist, dass man merkt, wie positiv es angenommen wird, dass wir Veranstaltungen machen, die auch in der Öffnungszeit schon beginnen. Das haben wir früher nicht gemacht. Wir haben immer erst geschlossen und dann um 19.30 Uhr was angefangen. Das war personell aufwendig und außerdem war es auch für die Kunden oder die Besucher gar nicht so optimal. Jetzt bleiben sie zum Teil hier, kriegen mit, um 17 Uhr beginnt hier irgendwas, beteiligen sich sogar. Also, das hat einen echten Mehrwert und das spricht auch dafür, dass die Kunden das gut finden. Also es gibt eine positive Resonanz.

Es gibt immer Einzelne, die sagen „Ich möchte hier meine Ruhe haben.“, aber auch dafür haben wir einen Raum geschaffen. Der zwar auch manchmal sehr gut gefüllt ist und dann wird es da doch lauter, aber wir sind immer noch dabei, die Zonen ein bisschen schärfer zu definieren.

MS: Das ist bei uns einfacher als in anderen Bibliotheken, weil wir gestapelt sind. Wir haben fünf Etagen. Andere Bibliotheken haben es eher in der Fläche und da ist es schwierig. Hier kann man schon die Etage ein bisschen anders definieren. Also im fünften Stock hinter dem Aufzug, das ist eine wunderschöne Ecke, da haben wir die Methothek angesiedelt. Die sind da für sich sozusagen. Dann gibt es Arbeitsräume mit Einzeltischen und Arbeitsräume mit Gruppenmöglichkeit. Das Untergeschoss, da sind wir jetzt dabei, da ist es auch noch mal stiller. [Dort] wollen wir Arbeitsplätze einrichten, aber eben auch ein bisschen gemütlichere, also keine Büroarbeitsplätze und nur Tisch und Stuhl, sondern auch mit ein bisschen Atmosphäre.

MS: Das ist ein bisschen saisonabhängig, also die Sekundarstufe 2, die Schüler die Facharbeiten schreiben und vor dem Abitur stehen, das ist eine große Gruppe, die auch unheimlich fleißig ist [lacht]. Das ist aber nur eine Gruppe; es gibt viele mittelalte Erwachsene, die sich hier aufhalten. Es gibt auch trotzdem noch die typischen Romanleser…

MS: Nee [lacht], die bedürfen auch einer besonderen Pflege, weil da ist der Inhalt eben nicht so objektivierbar, wie es jetzt gerade im Trend ist. Bei BWL braucht man das, bei Technik und EDV das… [Bei Romanen] muss schon ein fachlicher Input von uns kommen. Menschen in Ausbildung, Deutschlernende, ganz viel. Und Menschen, die einfach miteinander sprechen wollen, das sieht man auch. Erfassen kann man das schlecht. Da müsste man ja wirklich gucken, für wen hält man jemanden. Ist das ein Schüler oder ist das ein Auszubildender. Lernt [die Person] Deutsch oder ist sie schon viele Jahre hier und liest einfach irgendeine Fachzeitschrift? Also das ist schwierig.

MS: Also diese Tendenz, dass junge Leute hier sind, die ist gestiegen. Das kann man sagen, ja. Leute mit einer höheren Lärmtoleranz auch. Das ist schon richtig trubelig hier. Da sagen manche – ich bin ja auch schon lange hier – viele ältere Kunden, das ihnen das hier jetzt oft auch zu laut ist. Nicht, weil es undiszipliniert laut ist, [es sind] einfach viele Menschen, die sich unterhalten. Das erhöht den Lärmpegel und das möchten manche nicht, aber das ist, glaube ich, die Minderheit.

MS: Ja, wobei man trotzdem sagen muss, wir haben ja den großen Innenhof und alles ist offen, so [geschlossen] sind die Etagen dann doch nicht, aber es ist zumindest ein Angebot.

MS: Also wir gehen zunehmend auch raus aus dem Haus. Kennen Sie das Aufhof-Projekt?

MS: Da waren wir auch, mit mäßigem Erfolg, aber wir waren da und das ist erstmal schon richtig [lacht]. Dann sind wir bei den Smart City Days dabei, bei jugendlichen Technikfreaks sozusagen [lacht], mit Robotik gehen wir um. Wir haben Anfang nächsten Jahres, Mitte nächsten Jahres, eine Technothek. Ganz kultur- und bildungsferne Menschen kriegen wir nur durch Kindergärten [und] Schulen oder durch andere Vermittler. Die Technothek soll eher die MINT-Fächer propagieren.

MS: Ja, das ist aber schon lange Standard.

MS: Ja. Und die Zielgruppen, auf die muss man eben oft zugehen. Man muss nicht um die Aufmerksamkeit betteln, sondern man muss sich einfach nur zeigen. Das ist ja oft das Problem, dass man nicht bekannt genug ist und wenn es dann bekannt wird, ist großes Erstaunen da.

MS: Also Herausforderungen gibt es zum Teil an die Mitarbeiter, weil auch ein anderes Publikum kommt. Es kann Konflikte geben, weil die Auffassung, wie man sich in einer Bibliothek verhält, eben doch verschieden sein können. Ich will das aber gar nicht so betonen, weil das für mich erstens nicht so eklatant ist und zweitens nicht so viel ist. [Es ist] kein Grund, sich von dem Konzept der Bibliothek als sozialer Raum wieder abzuwenden, aber man muss es natürlich sehen. Das Thema Wohnungslosigkeit haben wir schon immer gehabt, damit muss man umgehen. Die kümmert es aber nicht, ob wir als Dritte Orte definieren oder nicht. Wenn es hier warm und trocken ist und draußen nass und kalt, dann kommen sie natürlich und sollen auch kommen, das ist völlig in Ordnung. Herausforderung sonst ist, dass es ein anderes Arbeiten ist. Also die klassische Auskunft zum Beispiel. Da kommt jemand und möchte wissen, wo steht welches Buch, das ist nicht mehr die Hauptarbeit.

MS: Die meisten kommen dann mit ihrem Handy und sagen, ich hab das Buch recherchiert und brauchen nur einen Hinweis, wo das jetzt ist. Das geht aber auch mit einer Ausschilderung. Es ist eher, dass man auch diese ganzen Begegnungen etwas moderiert, die hier stattfinden. Sehr viel Komplikationen und extrovertierteres Verhalten als früher vielleicht [lacht]. Aber auch nicht zu viel Regeln. Man muss schon auch als Mitarbeiter, der hier im Hause arbeitet, zulassen können, dass zum Beispiel die Möbel flexibel genutzt werden.

MS: Also es ist schon so, dass die Leute die Begegnung suchen, auch wenn sie das herkömmliche Bibliothekserleben nicht so haben, sondern ein anderes. Wir haben hier mehrere Personen, die um 9 Uhr kommen, mit ihrer Tasche und ihrem Laptop, und dann bis 14 Uhr hier sitzen, zwischendurch Kaffee trinken gehen, offenbar hier arbeiten. Also die nutzen den digitalen Raum, ein gutes WLAN, also eine relativ ideale Arbeitsatmosphäre. Man ist nicht allein und muss sich selber auch irgendwie disziplinieren. Aber Digitalisierung meinen Sie jetzt nicht [insofern als dass] wir die Medien digital zur Verfügung stellen?

MS: Die persönliche, dann?

MS: Ja das könnte ich so bestätigen. Wir merken das zum Beispiel im Queeren Wohnzimmer. [Dort] hatten wir mehrere Lesungen mit hauptsächlich jungen Autoren, die offenbar eine Szene bedienen. Da kommen die Leute aus Oldenburg mit ihren Eltern, weil sie diese Person lesen/sehen/hören wollen und andere treffen [wollen], die [den Autor] auch toll finden. Also das Phänomen, Lesen, Vorlesen, Lesungen, ist schon dann auch wieder im Plus und im Fluß.

MS: Wenn sie so weitermachen, wie wir, ja [lacht]. Also das ist glaube ich der springende Punkt. Wenn sie sich an den Bedürfnisse der Bevölkerung orientieren, ohne das Erbe, oder banal gesagt, das Buch, aufzugeben. Das ist ja kein entweder oder sondern es ist beides. Und es gibt Phasen, da hat der Bestand das Vorrecht gehabt und dann kommt die Welle: jetzt hat der Raum das Vorrecht und es wird sich irgendwie einpendeln zu einem bestimmten Maß.

MS: Wir hatten zwei Jahre lang einen Raum unten, das war ein Garderobenraum, mit hässlichen Schränken [lacht], den haben wir leer geräumt und zum Experimentierraum gemacht und haben [diesen Raum] verschiedenen Akteuren zur Verfügung gestellt. Jeweils vier Monate. Da gab es einmal das Thema Job und Karriere. Da war das Jobcenter dabei und die Sparkasse hat den Jugendlichen erzählt, wie man ein Konto eröffnet, mit Geld umgeht. Das andere war die Artothek. Kennen Sie die?

MS: Die war hier für vier Monate und hat den Raum völlig anders umgestaltet und hat hier eine ganz andere Atmosphäre reingebracht. [Danach hat die Artothek] eine andere Unterkunft bekommen und wir hatten dann wieder ein neues Projekt. Das wollen wir noch ein bisschen weitermachen, dass einfach die Menschen hierherkommen können und was machen können. Das wollen wir ausbauen. Die Projekte, die wir angefangen haben sind auch noch am laufen, es ist noch nicht zu Ende. Was unten im Experimentierraum startet, soll verstetigt werden. Die Methothek, startete auch im Experimentierraum und hat jetzt einen Ort bekommen. Genauso das Queere Wohnzimmer. Die Veranstaltungsreihe ist vorbei, aber für die Community sind wir weiter als Ort da, den sie eigenständig bespielen können. Das wird ein ideeller Ort werden, also das ist… wir haben so ein quietschbuntes Sofa aus dem Schauspielhaus. Haben Sie das gesehen?

MS: [lacht] Ja, das ist ne Leihgabe, das Wohnzimmer ist jetzt auch aufgelöst. Aber wir haben gesagt, von der Idee zum Ort. Nee, umgekehrt. Vom Ort zur Idee. Also die Idee bleibt erhalten, so als Haltung oder als Statement oder als Raum für Aktion.

Durch das Interview mit Michael Stünkel über Bibliotheken als Dritte Orte konnte ich wertvolle Einblicke gewinnen und besser verstehen, wie Bibliotheken der Zukunft den sozialen Aspekt in den Mittelpunkt stellen, um Gemeinschaft zu fördern. Besonders faszinierend ist, dass Bibliotheken ein besonders niedrigschwelliges Angebot schaffen, um als Dritte Orte zu fungieren. Man muss kein konkretes Ziel haben, um eine Bibliothek zu besuchen: Vielleicht schaut man sich einfach die Neuzugänge an, liest die Zeitung oder bringt Bücher zurück – und entdeckt plötzlich eine Veranstaltung, die einen zum Bleiben einlädt. Diese Ungezwungenheit ermöglicht es, soziale Teilhabe ohne die Verpflichtung zu erleben, gezielt an einem Angebot teilnehmen zu müssen. Dabei wurde deutlich, dass dieser Ansatz zwar nicht alle Bedürfnisse gleichermaßen erfüllen kann, jedoch essenziell für die Weiterentwicklung moderner Bibliotheken ist. Es ist ein Thema, das sich kontinuierlich wandelt und weiterentwickelt – eine Dynamik, die besonders spannend und bedeutsam bleibt. Weißt du, was dein Dritter Ort ist? Mache das Quiz und finde es heraus!

Quellen

¹ Archive/Stadtbibliothek-Hannover/Veranstaltungen/Workshop-s-in-der-MethoThek-der-Stadtbibliothek-Hannover/Was-ist-die-MethoThek

² https://www.wirtschaftsfoerderung-hannover.de/de/Microsites/aufHof/aufhof.php

³ https://www.hannover.de/Leben-in-der-Region-Hannover/Bildung/Bibliotheken-

https://artothek-hannover.de/

Bildnachweise

https://www.pexels.com/de-de/foto/gruppe-von-personen-1472334/

https://www.mattynewton.com/

https://www.hannover.de/Leben-in-der-Region-Hannover/Bildung/Bibliotheken-Archive/Stadtbibliothek-Hannover

https://www.pexels.com/de-de/foto/person-die-weisse-kreide-halt-625219/

https://www.hannover.de/Service/Presse-Medien/Landeshauptstadt-Hannover/Meldungsarchiv-f%C3%BCr-das-Jahr-2024/%E2%80%9Eaufhof%E2%80%9C-soll-verl%C3%A4ngert-werden

https://artothek-hannover.de/

Autorin: Anna Feldbarg

Willkommen in einer digitalen Ära, die uns unendliche kreative Möglichkeiten bietet! Vor allem Instagram hat eine Bühne geschaffen, auf der wir unser künstlerisches Talent entfalten und fesselnde Geschichten erzählen können. Und das Beste daran ist: Als Foodblogger:in kannst du deine Rezepte jetzt noch lebendiger gestalten! Dank der Zusammenarbeit zwischen Canva1 – einer herausragenden visuellen Design-Plattform, und der beeindruckenden KI-Generierung von ChatGPT2 – wird dein Instagram-Profil zu einem magischen Ort voller Innovation und Inspiration. Zögere nicht länger und tauche mit mir in die visuelle Magie von Instagram ein!

Lass die Flammen deiner Kreativität lodern. Auch wenn du als Foodblogger:in schon viele Gerichte kreiert hast, kann es immer wieder vorkommen, dass dir der Funke der Inspiration fehlt. Doch keine Sorge – hier kommt ChatGPT ins Spiel. Diese innovative KI-Plattform generiert Ideen und Texte für dich, damit du auch bei einem scheinbar simplen Rezept wie dem Tomaten-Mozzarella-Salat deine Leser:innen mit kreativen Beschreibungen begeistern kannst.

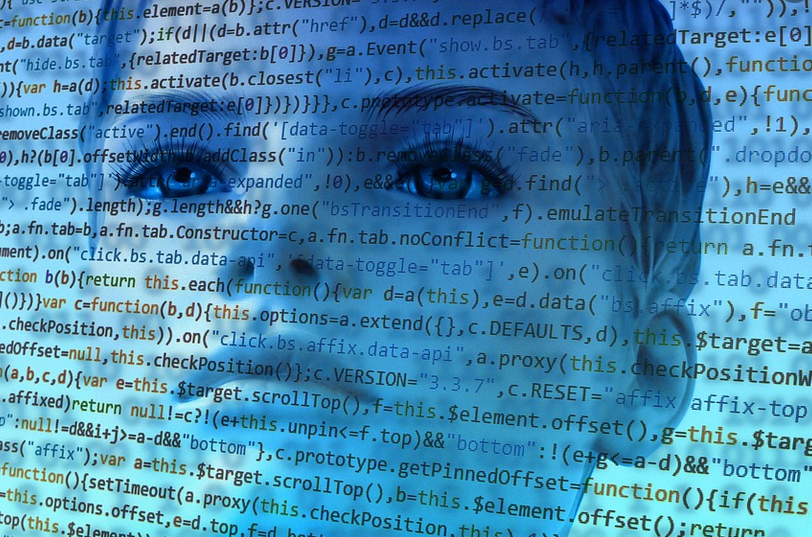

KI bezieht sich auf Menschen und Programme, die menschenähnliche Denk- und Entscheidungsprozesse simulieren können. In diesem Kontext wird KI verwendet, um Texte und Inhalte auf kreativer Weise zu generieren.3

Doch das ist erst der Anfang! Hier kommt die Macht von ChatGPT ins Spiel, welche den Ideen magisches Leben einhaucht und damit den Auftakt für eine atemberaubende Transformation in verführerische Instagram-Posts setzt.

Jetzt betritt Canva die Bühne und präsentiert stolz seine beeindruckenden Vorlagen und unzähligen Designelemente. Als Foodblogger:in hast du somit endlich das Werkzeug an der Hand, um deine kreativen Meisterwerke in visuelle Kunstwerke zu verwandeln! Greife jetzt geschickt auf die von ChatGPT erzeugten Texte zurück und erschaffe so eine holistische Erzählung, welche die Schönheit deiner kulinarischen Kreationen perfekt unterstreicht.

Starte deine visuelle Magie mit Instagram Reise mit ChatGPT durch das Generieren von inspirierenden Ideen und Textfragmenten. Anschließend erstellt ChatGPT eine strukturierte Tabelle für dich, die alle Elemente deiner Instagram-Posts organisiert – von überzeugenden Textvorschlägen bis hin zu passenden Hashtags und exakten Bildbeschreibungen. Diese zentrale Tabelle wird zum Dreh- und Angelpunkt deines gesamten Prozesses und schafft Ordnung für die anschließende visuelle Gestaltung.

Wenn du eine Instagram-Vorlage kreieren möchtest, die perfekt zu deiner Marke passt, gibt es einige wichtige Schritte zu beachten. Zum Glück ist Canva eine großartige Lösung für alle deine Designbedürfnisse! Beginne damit, das richtige Format auszuwählen und sorgfältig ausgewählte Bausteine einzufügen, die gezielt Informationen aus der ChatGPT-Tabelle integrieren. Mit dieser soliden Grundlage kannst du dann dein visuelles Meisterwerk entwerfen und dein Publikum begeistern!

Mit einem Canva Pro-Konto erhältst du Zugang zur innovativen Funktion der automatischen Design-Erstellung.5 Beginne, indem du die Tabellendaten von ChatGPT in dein Canva-Konto importierst und genieße das Ergebnis! Mit nur einem Klick verknüpfst du die Bausteine der Vorlage mit den relevanten Informationen aus deinen Tabellen und beobachte, wie Canva magisch alle Elemente für dich anordnet. So einfach geht’s – lass dich begeistern!

Die Feinabstimmung ist entscheidend. Ein kurzer Blick auf das fertige Design hilft, Details zu optimieren und sicherzustellen, dass jedes Element perfekt harmoniert. Sobald dein Werk fertig ist, kannst du es hochladen und auf Instagram veröffentlichen.

Die sorgfältig erstellten Beiträge warten darauf, auf Instagram präsentiert zu werden. Integriere den von ChatGPT generierten Bildbeschreibungstext nahtlos in dein visuelles Gesamtkunstwerk und erreiche so ein perfektes Ergebnis. Lade mit einem Klick deine Kreationen hoch und teile inspirierende Geschichten sowie kulinarische Erlebnisse mit deiner Community – Schritt für Schritt zum Erfolg!

Deine visuelle Magie auf Instagram – die Reise von der ersten Idee bis zur Veröffentlichung wird durch die gekonnte Verschmelzung von Canva und ChatGPT zu einem visuellen Vergnügen der Extraklasse. Durch die Symbiose von Kreativität und Technologie entstehen so Instagram-Posts, die nicht nur visuell beeindrucken, sondern auch Geschichten auf unvergleichliche Weise erzählen.

Bist du bereit, deiner Kreativität freien Lauf zu lassen? Erwecke deine Instagram-Posts mit der Magie von Canva und der künstlichen Intelligenz von ChatGPT zum Leben! 🚀 Lass dich inspirieren und teile uns deine Gedanken gerne in den Kommentaren mit!

Autor: Oguzhan-Burak Bozkurt

Durch den kontinuierlichen und raschen Fortschritt in jüngster Zeit auf den Gebieten von Big Data und KI-Technologien sind heutzutage insbesondere Teilbereiche des Informationsmanagements gefragter als je zuvor. Die Rolle des Informationsmanagers und Data Scientists besteht darin, Methoden zur Erfassung und Verarbeitung von Informationen aus unterschiedlichen Datenquellen anzuwenden. Zudem ist er befähigt, Entscheidungen darüber zu treffen, welche Verarbeitungsprozesse zur gezielten Knowledge Discovery aus umfangreichen Datensätzen geeignet sind. Hierbei kommt Data Mining ins Spiel, eine Methode, die die systematische Extraktion relevanter Informationen und Erkenntnisse aus großen Datenmengen umfasst.

In diesem Blogbeitrag werden wir tiefer in das Thema eintauchen und uns einem von vielen Verfahren des Data Mining, genauer der Sentimentanalyse im Text Mining, praxisnah annähern. Dabei bin ich der Ansicht, dass ein tieferes Verständnis erreicht wird, wenn das theoretisch Gelernte eigenständig umgesetzt werden kann, anstatt lediglich neue Buzzwörter kennenzulernen. Ziel ist eine Sentimentanalyse zu Beiträgen auf der Social Media Plattform X (ehemals Twitter) mit Verfahren aus dem Machine Learning bzw. einem passenden Modell aus Hugging Face umzusetzen.

Ihr könnt euch in die Hintergründe einlesen oder direkt zum Coden überspringen.

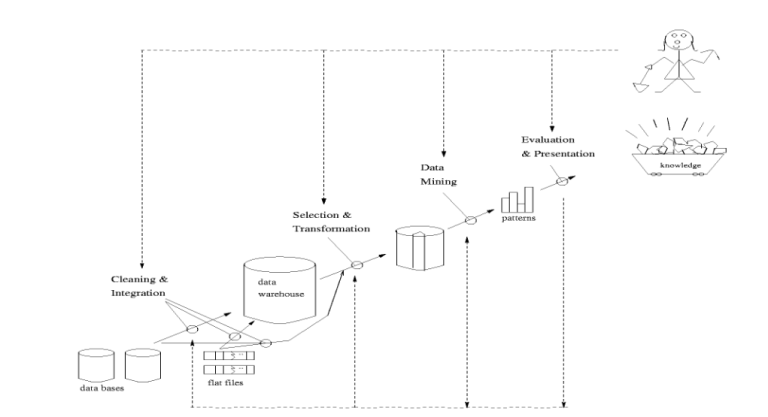

Data Mining umfasst die Extraktion von relevanten Informationen und Erkenntnissen aus umfangreichen Datensammlungen. Ähnlich wird auch der Begriff „Knowledge Discovery in Databases“ (KDD) verwendet. Die Hauptaufgabe besteht darin, Verhaltensmuster und Prognosen aus den Daten zu identifizieren, um darauf basierend Trends zu erkennen und angemessen darauf zu reagieren. Dieser analytische Prozess des Data Mining erfolgt mithilfe von computergestützten Methoden, deren Wurzeln in den Bereichen Mathematik, Informatik und insbesondere Statistik liegen. Data Mining kann als Teilprozess innerhalb des umfassenden Datenanalyseprozesses verstanden werden, der folgendermaßen strukturiert ist:

Die Data Mining Verfahren dienen dazu, den Datenbestand zu beschreiben und zukünftige Entwicklungen vorherzusagen. Hierbei kommen Klassifikations- und Regressionsmethoden aus dem statistischen Bereich zum Einsatz. Zuvor ist es jedoch notwendig, die Zielvariable festzulegen, die Daten aufzubereiten und Modelle zu erstellen. Die gebräuchlichen Methoden ermöglichen die Analyse spezifischer Kriterien wie Ausreißer- und Clusteranalyse, die Verallgemeinerung von Datensätzen, die Klassifizierung von Daten und die Untersuchung von Datenabhängigkeiten.

Zusätzlich zu den herkömmlichen statistischen Methoden können auch Deep Learning-Algorithmen verwendet werden. Hierbei werden Modelle aus dem Bereich des Machine Learning unter Anwendung von überwachtem (bei gelabelten Daten) oder unüberwachtem (bei nicht gelabelten Daten) Lernen eingesetzt, um die Zielvariablen möglichst präzise vorherzusagen. Eine wesentliche Voraussetzung für das Vorhersagemodell ist ein Trainingsdatensatz mit bereits definierten Zielvariablen, auf den das Modell anschließend trainiert wird.

Ein Teilbereich des Data Mining, der auch maßgeblich maschinelles Lernen einbezieht, ist das Text Mining. Hierbei zielt das Text Mining darauf ab, unstrukturierte Daten aus Texten, wie beispielsweise in sozialen Netzwerken veröffentlichte Inhalte, Kundenbewertungen auf Online-Marktplätzen oder lokal gespeicherte Textdateien, in strukturierte Daten umzuwandeln. Für das Text Mining dienen oft Datenquellen, die nicht direkt zugänglich sind, weshalb Daten über APIs oder Web-Scraping beschafft werden. Im darauf folgenden Schritt werden Merkmale (Features) gebildet und die Daten vorverarbeitet. Hierbei erfolgt die Analyse der Texte mithilfe von natürlicher Sprachverarbeitung (Natural Language Processing – NLP) unter Berücksichtigung von Eigenschaften wie Wortfrequenz, Satzlänge und Sprache.

Die Vorverarbeitung der Daten wird durch Techniken des maschinellen Lernens ermöglicht, zu denen Folgendes gehört:

Insgesamt kann der Text Mining-Prozess als Teil einer breiteren Datenanalyse oder Wissensentdeckung verstanden werden, bei dem die vorverarbeiteten Textdaten als Ausgangspunkt für weitere Schritte dienen.

The effort of using machines to mimic the human mind has always struck me as rather silly. I would rather use them to mimic something better.

Edsger Wybe Dijkstra

In unserem nächsten Abschnitt werden wir auf die Sentimentanalyse eingehen und schrittweise demonstrieren, wie sie mit Hilfe von Modellen auf Hugging Face für Beiträge auf der Plattform X (ehemalig Twitter) durchgeführt werden kann.

Das 2016 gegründete Unternehmen Hugging Face mit Sitz in New York City ist eine Data Science und Machine Learning Plattform. Ähnlich wie GitHub ist Hugging Face gleichzeitig ein Open Source Hub für AI-Experten und -Enthusiasten. Der Einsatz von Huggin Face ist es, KI-Modelle durch Open Source Infrastruktur und Repositories für die breite Maße zugänglicher zu machen. Populär ist die Plattform unter anderem für seine hauseigene Open Source Bibliothek Transformers, die auf ML-Frameworks wie PyTorch, TensorFlow und JAX aufbauend verschiedene vortrainierte Modelle aus den Bereichen NLP, Computer Vision, Audio und Multimodale anhand von APIs zur Verfügung stellt.

Für die Sentimentanalyse stehen uns über 200 Modelle auf der Plattform zur Verfügung. Wir werden im folgenden eine einfache Sentimentanalyse unter Verwendung von Transformers und Python durchführen. Unsere KI soll am Ende Ton, Gefühl und Stimmung eines Social Media Posts erkennen können.

Viel Spaß beim Bauen! 🦾

Zunächst brauchen wir Daten aus X/Twitter. Da im Anschluss auf die neuen Richtlinien die Twitter API jedoch extrem eingeschränkt wurde (rate limits, kostenspielige read Berechtigung) und es nun auch viele Scraping-Methoden getroffen hat, werden wir bereits vorhandene Daten aus Kaggle verwenden.

Wir entscheiden uns für einen Datensatz, der sich für eine Sentimentanalyse eignet. Da wir mit einem Text-Mining Modell in Transformers arbeiten werden, welches NLP verwendet um das Sentiment eines Textes zuordnen zu können, sollten wir uns für einen Datensatz entscheiden, in dem sich Texte für unsere Zielvariable (das Sentiment) befinden.

Hier kann ein Datensatz aus Kaggle verwendet werden, in dem über 80 Tausend englische Tweets über das Thema „Crypto“ in dem Zeitraum vom 28.08.2022 – 29.08.2022 gesammelt wurde: 🐦 🪙 💸 Crypto Tweets | 80k in English | Aug 2022 🐦 🪙 💸

Wir laden das Archiv herunter und entpacken die crypto-query-tweets.csv in unseren Projektordner.

Wir wollen in einer überschaubaren Anzahl an Tweets das jeweilige Sentiment zuordnen. Dazu schauen wir uns den Datensatz aus der CSV Datei genauer an. Uns interessieren dabei besonders Tweets von verifizierten Usern. Mit der Pandas Bibliothekt läss sich der Datensatz in Dataframes laden und nach bestimmten kriterien filtern.

wir installieren zunächst per pip-install die gewünschte Bibliothek und importieren diese in unsere Codebase.

pip install pandasAnschließends lesen wir die CSV-Datei ein und filtern entsprechend unseren Wünschen den Datensatz und geben diesen als Dataframe aus.

import pandas as pd

# CSV Datei lesen

csv_file_path = "crypto-query-tweets.csv"

df = pd.read_csv(csv_file_path, usecols=['date_time', 'username', 'verified', 'tweet_text'])

# Filter anwenden um nur verifizierte User zu erhalten

filtered_df = df[df['verified'] == True]

# Printe Dataframe

print(filtered_df)Wir erhalten folgende Ausgabe von 695 Zeilen und 4 Spalten:

date_time username verified tweet_text

19 2022-08-29 11:44:47+00:00 RR2Capital True #Ethereum (ETH)\n\nEthereum is currently the s...24 2022-08-29 11:44:45+00:00 RR2Capital True #Bitcoin (BTC)\n\nThe world’s first and larges...

25 2022-08-29 11:44:43+00:00 RR2Capital True TOP 10 TRENDING CRYPTO COINS FOR 2023\n \nWe h...

146 2022-08-29 11:42:39+00:00 ELLEmagazine True A Weekend in the Woods With Crypto’s Cool Kids...

155 2022-08-29 11:42:32+00:00 sofizamolo True Shill me your favorite #crypto project👇🏻🤩

... ... ... ... ...

79383 2022-08-28 12:36:34+00:00 hernanlafalce True @VerseOort My proposal is as good as your proj...

79813 2022-08-28 12:30:15+00:00 NEARProtocol True 💫NEARCON Speaker Announcement💫\n\nWe're bringi...

79846 2022-08-28 12:30:00+00:00 lcx True 🚀@LCX enables project teams to focus on produc...

79919 2022-08-28 12:28:56+00:00 iSocialFanz True Friday.. Heading to Columbus Ohio for a Web 3....

79995 2022-08-28 12:27:46+00:00 BloombergAsia True Bitcoin appeared stuck around $20,000 on Sunda...

[695 rows x 4 columns]Nun können wir mit Hugging Face Transformers eine vortrainiertes Modell verwenden, um allen Tweets entsprechende Sentiment Scores zuzuweisen. Wir nehmen hierfür das Modell Twitter-roBERTa-base for Sentiment Analysis, welches mit über 50 Millionen Tweets trainiert wurde und auf das TweetEval Benchmark für Tweet-Klassifizierung aufbaut. Weitere Infos unter dieser BibTex entry:

@inproceedings{barbieri-etal-2020-tweeteval,

title = "{T}weet{E}val: Unified Benchmark and Comparative Evaluation for Tweet Classification",

author = "Barbieri, Francesco and

Camacho-Collados, Jose and

Espinosa Anke, Luis and

Neves, Leonardo",

booktitle = "Findings of the Association for Computational Linguistics: EMNLP 2020",

month = nov,

year = "2020",

address = "Online",

publisher = "Association for Computational Linguistics",

url = "https://aclanthology.org/2020.findings-emnlp.148",

doi = "10.18653/v1/2020.findings-emnlp.148",

pages = "1644--1650"

}Wir installieren alle für den weiteren Verlauf benötigten Bibliotheken.

pip install transformers numpy scipyDie Transformers Bibliothekt erlaubt uns den Zugriff auf das benötigte Modell für die Sentimentanalyse. Mit scipy softmax und numpy werden wir die Sentiment Scores ausgeben mit Werten zwischen 0.0 und 1.0, die folgendermaßen für alle 3 Labels ausgegeben werden:

Labels: 0 -> Negative; 1 -> Neutral; 2 -> Positive

Importieren der Bibliotheken:

from transformers import AutoModelForSequenceClassification

from transformers import AutoTokenizer

import numpy as np

from scipy.special import softmax

import csv

import urllib.requestWir schreiben eine Methode zum vorverarbeiten des Texts. Hier sollen später Usernamen und Links aussortiert werden. Außerdem vergeben wir das gewünschte Modell mit dem gewünschten Task (’sentiment‘) in eine vorgesehene Variable und laden einen AutoTokenizer ein, um später eine einfach Eingabe-Enkodierung zu generieren.

# Vorverarbeitung des texts

def preprocess(text):

new_text = []

for t in text.split(" "):

t = '@user' if t.startswith('@') and len(t) > 1 else t

t = 'http' if t.startswith('http') else t

new_text.append(t)

return " ".join(new_text)

task='sentiment'

MODEL = f"cardiffnlp/twitter-roberta-base-{task}"

tokenizer = AutoTokenizer.from_pretrained(MODEL)

Als nächstes laden wir das Label Mapping aus TweetEval für das zugeordnete Task ’sentiment‘ herunter. Das Modell für die Sequenzklassifizierung kann nun gespeichert und in der ‚model‘ Variable hinterlegt werden.

# download label mapping

labels=[]

mapping_link = f"https://raw.githubusercontent.com/cardiffnlp/tweeteval/main/datasets/{task}/mapping.txt"

with urllib.request.urlopen(mapping_link) as f:

html = f.read().decode('utf-8').split("\n")

csvreader = csv.reader(html, delimiter='\t')

labels = [row[1] for row in csvreader if len(row) > 1]

# Modell laden

model = AutoModelForSequenceClassification.from_pretrained(MODEL)

model.save_pretrained(MODEL)

Im nächsten Schritt schreiben wir zwei Methoden, die dabei helfen sollen zeilenweise Tweet-Texte zu enkodieren und ein Sentiment Score zu vergeben. In einem Array sentiment_results legen wir alle Labels und entsprechende Scores ab.

# Sentiment Scores für alle Tweets erhalten

def get_sentiment(text):

text = preprocess(text)

encoded_input = tokenizer(text, return_tensors='pt')

output = model(**encoded_input)

scores = output.logits[0].detach().numpy()

scores = softmax(scores)

return scores

# Sentimentanalyse für jede Zeile im Datensatz anwenden

def analyze_sentiment(row):

scores = get_sentiment(row['tweet_text'])

ranking = np.argsort(scores)

ranking = ranking[::-1]

sentiment_results = []

for i in range(scores.shape[0]):

l = labels[ranking[i]]

s = scores[ranking[i]]

sentiment_results.append((l, np.round(float(s), 4)))

return sentiment_results

Zum Schluss wir das Dataframe um unser Ergebnis erweitert. Hierzu erstellen wir eine neue Spalte ’sentiment‘ und fügen mit der apply-Funktion die Ergebnisse aus unserer vorherigen Methode analyze_sentiement hinzu. Am Ende geben wir unser neues Dataframe in der Konsole aus.

# Ergebnisse in neue Spalte "sentiment" speichern

filtered_df['sentiment'] = filtered_df.apply(analyze_sentiment, axis=1)

# Ausgabe des neuen DataFrames

print(filtered_df)Wir erhalten ein neues Dataframe mit einer weiteren Spalte in der das Label und die Sentiment-Scores festgehalten werden! 🤗🚀

Den gesamten Code könnt ihr euch auch auf meinem GitHub Profil ansehen oder klonen.

Han, Jiawei (2006). Data Mining: Concepts and Techniques, Simon Fraser University.

Barbieri, F., Camacho-Collados, J., Espinosa Anke, L., & Neves, L. (2020). Tweet Eval: Unified Benchmark and Comparative Evaluation for Tweet Classification. In Findings of the Association for Computational Linguistics: EMNLP 2020, S. 1644-1650. https://aclanthology.org/2020.findings-emnlp.148.

Hugging Face Transformers: https://huggingface.co/docs/transformers/index. Zuletzt aktualisiert am 27.08.2023.

Kaggle Dataset: Leonel do Nascimento, Tiago; „Crypto Tweets | 80k in ENG | Aug 2022 „: https://www.kaggle.com/datasets/tleonel/crypto-tweets-80k-in-eng-aug-2022. (CC0 Public Domain Lizens), zuletzt aktualisiert am 27.08.2023.

Wartena, Christian & Koraljka Golub (2021). Evaluierung von Verschlagwortung im Kontext des Information Retrievals. In Qualität in der Inhaltserschließung, 70:325–48. Bibliotheks- und Informationspraxis. De Gruyter, 2021. https://doi.org/10.1515/9783110691597.

Autor*innen: Leoni Albert und Elias Huisl

Aufgrund der aktuell steigenden Energiekosten wird das Thema „Energiesparen“ für Verbraucher*innen immer wichtiger.1 In dem folgenden Artikel untersuchen wir gemeinsam, ob Energiesparen durch Smart Home möglich ist und mit welchen Tools Sie Kosten sparen können.

Ein Smart Home muss nicht immer ein aufwändiger Neubau sein, bereits durch kleine Änderungen können Sie Ihre vorhandenen Geräte und die Infrastruktur modernisieren.

Ganz einfach können klassische Heizkörperthermostate durch smarte ausgetauscht werden. Die Heizung reguliert sich selbst, dadurch können Sie nicht mehr vergessen, sie auszuschalten. Sind zusätzlich noch Fensterkontakte verbaut, kann die Heizung darauf reagieren und bei geöffneten Fenstern das Heizen unterbrechen. Dadurch können Heizkosten gespart werden.2

Durch Bewegungssensoren wird die Beleuchtung lediglich bei Bedarf genutzt. Des Weiteren können Sensoren Tageslicht erkennen und dementsprechend die Lampen ausschalten oder dimmen. Auch praktisch: Durch festgelegte Timer können Sie oder Ihre Mitbewohner*innen nicht mehr vergessen, das Licht auszuschalten.3

Fernseher oder Bürogeräte wie Drucker und Bildschirm verbrauchen auch nach dem Ausschalten weiterhin Strom. Grund hierfür ist der sogenannte Standby-Modus. Durch smarte Zwischenstecker können die Geräte komplett vom Strom genommen werden und Sie schalten sie nur bei Bedarf ein.4

Smarte Stromzähler werten den Stromverbrauch aus und warnen bei überdurchschnittlich hohem Verbrauch. Dadurch können Sie direkt reagieren und nach Ursachen für den hohen Stromverbrauch suchen.5 Sogar von unterwegs oder aus dem Urlaub.

Das große Problem an Energieeinsparungen durch smarte Technik ist der hohe Stromverbrauch der benötigten Geräte. Diese entpuppen sich oft als Energiesparfalle. Durch die dauerhafte Betriebsbereitschaft ziehen sie ununterbrochen Strom – meistens sogar im ausgeschalteten Zustand! Dadurch ist klar, dass sich der Stromverbrauch erhöhen wird.

Trotz diesen Mehrkosten ist laut Studie der Verbraucherzentrale Nordrhein-Westfalen jährliche Einsparungen der Energiekosten in Höhe von 140 € möglich.6 Aufgrund der steigenden Energiekosten wird die Einsparung 2023 sogar sehr wahrscheinlich noch größer ausfallen.7 Allerdings kann dieses Potenzial nur erreicht werden, wenn bei der Auswahl der Geräte nicht nur der Komfort, sondern vor allem die Effizienz im Vordergrund steht.

Zur maximalen Einsparung ist es umso wichtiger, dass Sie klären: Wie viel Luxus möchten Sie mit der Umrüstung erreichen? Muss die Kaffeemaschine wirklich aus dem Bett heraus betrieben werden?

Es ist durchaus möglich, dass Sie durch Smart Home Energie einsparen können. Allerdings muss dazu weitestgehend auf komfortable Technik verzichtet werden und das Augenmerk auf die Energieeffizienz gesetzt werden. Außerdem sollten Sie im Vorfeld ausrechnen, wie hoch die Anschaffungskosten sind und ob diese Kosten sich durch die Energieeinsparungen rentieren.

1Focus (2022): Stadtwerke verdoppeln Strompreise – ist Ihr Anbieter auch dabei? Zuletzt akutalisiert am 23.11.2022. Online unter: https://www.focus.de/finanzen/news/so-reagieren-sie-richtig-stadtwerke-verdoppeln-strompreis-ist-ihr-anbieter-auch-dabei_id_180314185.html [Abruf am 24.11.2022]

2Spiegel (2022): Wenn die Heizung auf Automatik läuft. Zuletzt aktualisiert am 22.10.2022. Online unter: https://www.spiegel.de/tests/haushalt/smarte-heizkoerperthermostate-im-test-wenn-die-heizung-auf-automatik-laeuft-a-e5a8957b-ce0a-4655-bb72-30f6a8dbaf12 [Abruf am 24.11.2022]

3Berliner Morgenpost (2022): Energie sparen. Wo sich smarte Helfer auszahlen. Zuletzt aktualisiert am 03.10.2022. Online unter: https://www.morgenpost.de/nachhaltigkeit/article236567553/gas-heizung-strom-sparen-smart-home.html [Abruf am 24.11.2022]

4Chip (2022): Stromverbrauch im Standby. Das müssen Sie darüber wissen. Zuletzt aktualisiert am 26.10.2022. Online unter: https://praxistipps.chip.de/stromverbrauch-im-standby-das-muessen-sie-darueber-wissen_149070 [Abruf am 24.11.2022]

5Henning, Peter A. (2016): SmartHome Hacks. Hausautomatisierung selber machen. 1. Auflage. Heidelberg: O’Reilly. Online unter: https://learning.oreilly.com/library/view/smarthome-hacks/9781492066705/?ar [Abruf am 24.11.2022] [E-Book]

6Verbraucherzentrale NRW (2020): Klimabilanz in Smart Home. Online unter: https://www.verbraucherzentrale.nrw/energie/studie-klimabilanz-im-smart-home-46768 [Abruf am 23.11.2022]

7Statista (2022): So stark sind die Energiekosten gestiegen. Online unter: https://de.statista.com/infografik/27457/entwicklung-der-energiepreise-fuer-private-haushalte-in-deutschland/ [Abruf am 23.11.2022]

Video: SWR Landesschau Baden-Württemberg (2017): Intelligente Stromzähler: Online unter: https://www.youtube.com/watch?v=At6gEcQEcfMm [Abruf am 27.11.2022]

Alle Bilder entsprechen der CCO-Lizenz.

Künstliche Intelligenz (KI) wird normalerweise damit in Verbindung gebracht, Menschen bei Aufgaben zu unterstützen, die durch Automatisierung besser erledigt werden können.

Mit dem fortschreitenden technischen Wandel ist es der KI heutzutage aber nicht nur möglich, fortschriftliche visuelle Effekte in Filmen zu liefern oder den Videoschnitt zu erleichtern, sondern auch Prognosen hinsichtlich des möglichen Erfolgs eines Filmes zu liefern und ganze Storyboards zu verfassen.

Die KI entwickelt sich immer mehr zu einer unausweichlichen Kraft, die Filme zukünftig weiter aufarbeiten und stetig verbessern wird. 1

Hinsichtlich der Verwendung von KI in der Filmproduktion sticht besonders der Science-Fiction-Kurzfilm „Sunspring“ ins Auge, welcher 2016 debütierte. Das Interessante an diesem Film ist, dass er auf den ersten Blick wie viele andere Science-Fiction-Filme wirken mag – bis zur Erkenntnis, dass dessen Drehbuch ausschließlich von einer KI geschrieben wurde, welche sich selbst den Namen „Benjamin“ zuteilte.

Es handelt sich hierbei um ein rekurrentes neuronales Netzwerk namens LSTM

(long short-term memory), welches vorher mit Drehbüchern verschiedenster Science-Fiction-Filme sowie -Serien gespeist wurde. Trotz oder gerade wegen dieses daraus resultierenden, sehr kuriosen Drehbuchs wurde der Kurzfilm mit drei Schauspielenden gedreht und erhielt dadurch große Aufmerksamkeit. 2

Benjamin kreierte im selben Kurzfilm auch die Musik. Das neuronale Netzwerk wurde hier, ähnlich wie bei der vorangegangenen Vorgehensweise, mit vielen verschiedenen Einflüssen trainiert. In diesem Fall mit über 30.000 verschiedensten Popsongs. 3

Als weitere Art der Unterstützung wird KI inzwischen im Zuge von weiteren bestehenden Produktionsabläufen sogar in Schnittprogramme implementiert. Dort kann sie unter anderem durch nur einen Klick Audio- oder auch Farbanpassungen vornehmen. 4

Doch nicht nur dort kommt künstliche Intelligenz in der Filmwelt der Postproduktion zum Einsatz. Im Bereich der visuellen Effekte kommt sie gerade beim Rotoskopieren zum Tragen, wo bestimmte Teile des Filmmaterials vom Hintergrund separiert werden. Rotoskopieren ist eine Technik, um animierte Filme und komplexe Bewegungsabläufe in Animationsfilmen realistischer wirken zu lassen. Als Beispiel dient hier das Unternehmen Array. Deren neuronales Netzwerk wurde mit Material gefüttert, welches von Visual Effect Artists arrangiert wurde. Nach ausreichendem Training kann das neuronale Netzwerk sogar ohne Unterstützung durch einen Greenscreen arbeiten. 5

Auch die Computersoftware „Massive“ sticht im Zuge der visuellen Effekte ins Auge. Ursprünglich für die „Herr der Ringe“-Trilogie entwickelt war diese mit Hilfe von künstlicher Intelligenz in der Lage, computergenerierte Armeen zu erstellen sowie realistische Schlachten in enormen Ausmaßen zu simulieren. „Massiv“ erschuf auch andere ikonische Kampfszenen der letzten Jahre, darunter Szenen aus „Game of Thrones“ sowie „Marvel’s Avengers: Endgame“. 6

Ein ganz anderer Bereich, welcher durch KI revolutioniert wird, ist die prognostische Ebene. Denn sie ist inzwischen auch dazu in der Lage, Prognosen über den möglichen Erfolg eines Filmes zu treffen. Zum Beispiel soll die vom Datenwissenschaftler Yves Bergquist entwickelte KI „Corto“ dank künstlicher neuronaler Netze in der Lage sein, den Erfolg eines Films vorherzusagen. Das funktioniert nicht nur durch Analyse verschiedenster Elemente aus dem Film direkt, sondern auch über Daten aus sozialen Medien, wo die KI durch verschiedene Äußerungen die Stimmung sowie den kognitiven Zustand der Nutzenden ermittelt, die verschiedene Medieninhalte zugeführt bekommen haben. 7

Aber Künstliche Intelligenz kann auch für ganz andere Zwecke genutzt werden. So konvertierte ein YouTuber namens Denis Shiryaev eine über 100 Jahre alte Filmaufnahme der französischen Lumière-Brüder aus dem Jahr 1895 durch die Unterstützung einer KI auf das Videoformat 4k sowie die Bildrate auf 60 Bilder pro Sekunde. Somit verfrachtete er den Film durch Unterstützung einer KI technisch ins aktuelle Zeitalter. Hier bestand zwar durchaus noch Verbesserungspotential, allerdings geschah der Vorgang mit wenig Aufwand und wies erneut eindrucksvoll auf, zu was künstliche Intelligenz inzwischen in der Lage ist. 8

Es ist wirklich erstaunlich zu sehen, was für einen großen Einfluss KI in der Welt der Filmproduktion hat und wie viele Bereiche dieser durch sie bereits vereinfacht werden können. Der damit verbundene technische Fortschritt eröffnete die letzten Jahre viele neue innovative Anwendungen in der gesamten Branche und ermöglicht Unternehmen nicht nur, die Effizienz ihrer Arbeitsabläufe zu steigern, sondern auch, ihre Arbeitskosten zu senken und mehr Umsatz zu generieren. 9

Trotz all dieser Vorteile sollte gerade ein Aspekt im Kopf verbleiben:

„KI ist weder nur ein Werkzeug noch ein vollständiger Ersatz für einen Schriftsteller. Man braucht eine Symbiose, um gemeinsam mit der Maschine Kunst zu kreieren.“ 10

Vladimir Alexeev

1 Datta, Angana; Goswami, Ruchi (2020): The Film Industry Leaps into Artificial Intelligence: Scope and Challenges by the Filmmakers. Zuletzt aktualisiert am 02.10.2020. Online unter: https://link.springer.com/chapter/10.1007/978-981-15-6014-9_80 [Abruf am 22.11.2022]

2 Alexeev, Vladimir (2022): KI als Filmemacher: Wie man Kurzfilme nur mit Machine-Learning-Modellen macht. Zuletzt aktualisiert am 15.07.2022. Online unter https://1e9.community/t/ki-als-filmemacher-wie-man-kurzfilme-nur-mit-machine-learning-modellen-macht/17523 [Abruf am 27.11.2022]

3 Newitz, Annalee (2016): Movie written by algorithm turns out to be hilarious and intense. Zuletzt aktualisiert am 30.05.2021. Online unter https://arstechnica.com/gaming/2021/05/an-ai-wrote-this-movie-and-its-strangely-moving/ [Abruf am 23.11.2022]

4 Antunes, Jose (2018). Artificial Intelligence at NAB 2018: real world Applications. Zuletzt aktualisiert am 09.04.2018. Online unter https://www.provideocoalition.com/artificial-intelligence-at-nab-2018-real-world-applications/ [Abruf am 27.11.2022]

5 Metz, Cade (2018): Lights, Camera, Artificial Action: Start-Up Is Taking A.I. tot he Movies. The New York Times. Zuletzt aktualisiert am 26.03.2018. Online unter https://www.nytimes.com/2018/03/26/technology/artificial-intelligence-hollywood.html [Abruf am 22.11.2022]

6 Carson, Erin (2022): How ‚Lord of the Rings‘ Used AI to Change Big-Screen Battles Forever. Zuletzt aktualisiert am 04.09.2022. Online unter https://www.cnet.com/culture/entertainment/features/how-lord-of-the-rings-used-ai-to-change-big-screen-battles-forever/ [Abruf am 30.11.2022]

7 Schneider, Vanessa (2019): Künstliche Intelligenz & Kultur: Warum Hollywood auf Algorithmen setzt. Zuletzt aktualisiert am 30.09.2019. Online unter https://www.br.de/kuenstliche-intelligenz/so-setzt-hollywood-auf-kuenstliche-intelligenz-machine-learning-100.html [Abruf am 24.11.2022]

8 Westphal, André (2020): Über 120 Jahre alter Film mit KI-Unterstützung zu 4K und 60 fps umgewandelt. Zuletzt aktualisiert am 07.02.2020. Online unter https://stadt-bremerhaven.de/ueber-120-jahre-alter-film-mit-ki-unterstuetzung-zu-4k-und-60-fps-umgewandelt/ [Abruf am 22.11.2022]

9 4 How Artificial Intelligence Is Used in the Film Industry. Online unter https://smartclick.ai/articles/how-artificial-intelligence-is-used-in-the-film-industry/ [Abruf am 28.11.2022]

10 Alexeev, Vladimir (2022): KI als Filmemacher: Wie man Kurzfilme nur mit Machine-Learning-Modellen macht. Zuletzt aktualisiert am 15.07.2022. Online unter https://1e9.community/t/ki-als-filmemacher-wie-man-kurzfilme-nur-mit-machine-learning-modellen-macht/17523 [Abruf am 28.11.2022]

Autorinnen: Bonnie Huntemann und Nicole Hafner

Die Filmindustrie und vor allem der Streaming-Anbieter Netflix haben in den letzten Jahren mit einem selbst produzierten Aufgebot an interaktiven Filmen eine Art Hype geschaffen.

Ob mit der ganzen Familie auf der Couch oder alleine in den öffentlichen Verkehrsmitteln: Zuschauer*innen empfinden eine starke Bindung zum Geschehen im Film. Mehr noch: durch die gefühlte Partizipation, die suggeriert wird und durch die Aufmerksamkeit, die vorausgesetzt wird um ein erfolgreiches interaktives Erlebnis zu erfahren, entsteht fast ein ähnlich starkes Gefühl von Teilhabe den Verlauf zu beeinflussen, wie bei modernen Videospielen.

Doch der Wunsch nach Interaktion mit dem Filmgeschehen ist keine neue Idee und hat seinen Ursprung schon gar nicht in der Streamingindustrie.

„Einen ersten Versuch mit interaktiven Filmelementen unternahm beispielsweise Winsor McCays Zeichentrick-Experiment Gertie the Dinosaur (USA 1914), für das der Regisseur sich bei jeder Vorführung vor der Leinwand positionierte und mit der gezeichneten Dinosaurierdame Gertie ‹interagierte›, die seine Befehle ‹befolgte› „

Auch wenn es sich hierbei zweifelsfrei nicht mal annähernd um tatsächliche Interaktion zwischen Publikum und Filmgeschehen handelt, wird deutlich, dass die Idee schon früh Wurzeln in der Filmindustrie geschlagen hat.

Aber was macht interaktive Filmelemente so interessant und in welchen Bereichen kann man Sie heute und in Zukunft nutzen?

„Videos zählen aktuell und vermutlich auch künftig zu den bedeutendsten digitalen Medien im Internet. Sie lassen sich für fast alle Anwendungsbereiche verwenden und können Sachverhalte und Zusammenhänge so anschaulich und authentisch darstellen, wie es mit keinem anderen Medientyp möglich ist.“

Die Filmindustrie entwickelt sich stetig weiter, immer auf der Suche nach einem neuen Trend, in den letzten 10 Jahren ging es beispielsweise von 3D über 4D zu interaktiven Filmen. Ziel ist es dabei dem Zuschauer immer mehr das Gefühl zu geben er wäre in das Geschehen involviert, ein Wandel von Betrachtung hin zur echten Interaktion.

Die Möglichkeit mitzuentscheiden, wie sich die Handlung im Film gestaltet erweckt im Betrachter zwar die glaubhafte Illusion von Interaktivität, dabei ist dies natürlich keine freie, selbst gefällte Entscheidung, wie wir sie aus dem realen Leben kennen.Denn Interaktivität im Film hat ihre Grenzen. Auch wenn vermeintliche Partizipation suggeriert wird, sind Entscheidungsmöglichkeiten, dadurch, dass sie schon bei der Produktion erdacht wurden, vorbestimmt und in einer Art Baum-Struktur deklariert. So ist es dem Zuschauer zwar nicht möglich irgendwie die Handlung zu beeinflussen, aber er kann in manchen Fällen doch zwischen zwei oder mehr vorgegebenen Möglichkeiten wählen.

Die Filmindustrie steht noch am Beginn der Entwicklung interaktiver Kinoerlebnisse, die zukünftigen Veröffentlichungen versprechen spannend zu werden, werden aber nie unser Bedürfnis nach echter Interaktivität decken können.

Autor*innen: Jessica Arnold und Jan Heinemeyer

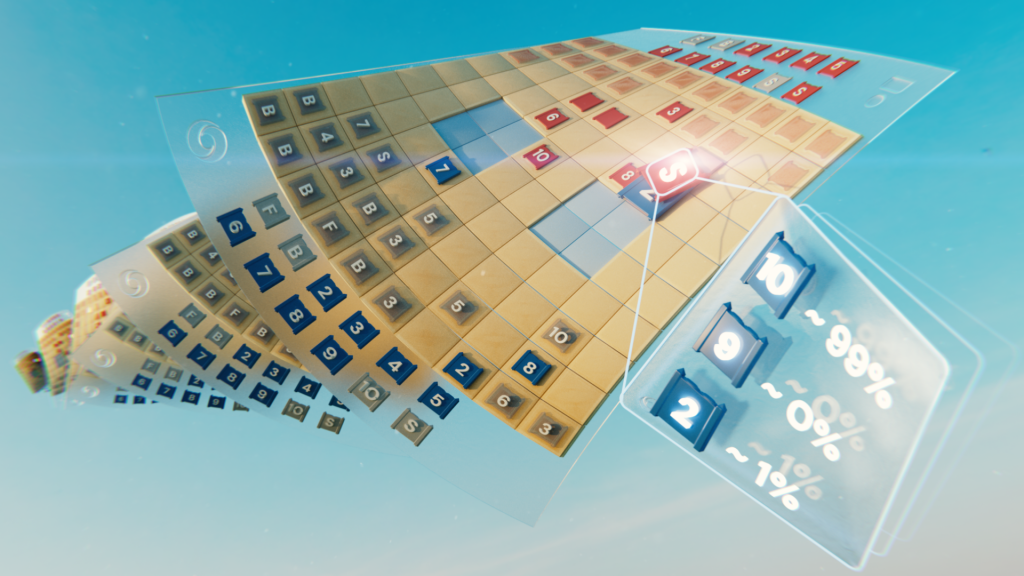

DeepNash ist die neue KI der Firma Deepmind, die erstmals in der Lage ist das Brettspiel Stratego trotz unvollständiger Informationen zu meistern.

Während die künstliche Intelligenz „AlphaZero“ Schach und „MuZero“ als Nachfolger verschiedene Spiele der Spielkonsole Atari meisterte, veröffentlichte die Firma Deepmind die nächste Entwicklungsstufe. Diese KI trägt den Namen DeepNash. AlphaZero meisterte Brettspiele mit klaren Regeln über ein modell-basiertes Training und MuZero, die schwer in Regeln auszudrückenden Atari-Spiele durch ein modell-freies Training. DeepNash hingegen legt sowohl die Spielregeln wie auch das Modell eines Spiels für die Planung fest. Die Besonderheit ist hierbei, dass von der gängigen Methode der Monte-Carlo-Baumsuche abgewichen wird. In der nachfolgenden Tabelle wird die unterschiedliche Komplexität von Brettspielen nochmals deutlich. [1][6]

| Schach | Poker | Go 19*19 | Stratego | |

|---|---|---|---|---|

| durchschnittliche Züge je Spiel | 60 | 15 | 300 | 1000 |

| mögliche Startaufstellungen | 1 | 106 | 1 | 1066 |

| Komplexität des Spielbaums | 10123 | 1017 | 10360 | 10535 |

Das Besondere an DeepNash ist, dass es in den Spielen versucht ein Nash-Gleichgewicht zu erreichen. Hierdurch verläuft das Spiel stabil. Das Nash-Gleichgewicht ist nach dem Spieltheorie-Mathematiker Jon Forbes Nash benannt. Die Theorie folgt der Annahme, dass ein Abweichen der Strategie zu einem schlechteren Ergebnis führt. DeepNash und das Nash-Gleichgewicht folgen also konstant einer Strategie. Infolgedessen hat DeepNash mindestens eine 50%ige Chance zu gewinnen. [1][3]

Die KI DeepNash nahm als Trainingsgrundlage das Brettspiel Stratego. Das Brettspiel hat im Schnitt 381 Spielzüge und die besondere Schwierigkeit, dass nicht alle Informationen von Beginn an gegeben sind, da mit verdeckten Figuren gespielt wird und der Gegner mit Hilfe von Bluffs i.d.R. seine Taktik verschleiert. Optimale Spielabläufe gibt es nicht, da die Züge inkonsequent sind, das heißt jederzeit ist das Spielergebnis offen. Es wird daher anders als beim Schach nicht in Zügen, sondern in Spielen gedacht. [1][3]

Die optimale Strategie in Stratego erreicht die KI nach 5,5 Milliarden simulierten Partien. [1] DeepNash besiegte damit 97% der derzeitigen Computersysteme und erreichte eine Siegesquote von 84% gegen menschliche Spieler auf der Online-Stratego-Plattform Gravon. DeepNash gelangte damit in die Top 3 der dortigen Bestenliste. Eine weitere Besonderheit der KI stellte die Anwendung menschlicher Spielstrategien dar. So zeigte DeepNash das Bluffen oder auch das Opfern von Figuren als Taktik. Der Algorithmus „Regularised Nash Dynamics“ (R-NaD) wird außerdem für Forschende als OpenSource Download auf Github zur Verfügung gestellt. [1][4][5]

DeepNash ist die nächste Weiterentwicklung, um Menschen in Brettspielen zu übertrumpfen und wird künftig als Grundlage für alltägliche Herausforderungen genutzt werden können. Insbesondere mit unvollständigen Informationen zu arbeiten stellt einen weiteren Meilenstein dar, der in der Lage ist bei komplexen Problemen wie der Optimierung des Verkehrssystems oder auch im Bereich des autonomen Fahrens – wie auch MuZero zuvor – einen Beitrag leisten zu können. [3][4][6]

Teste nun dein Wissen über DeepNash in einem kleinen Quiz.

Die Autorin Jessica Arnold arbeitet derzeit in der Hochschulbibliothek Emden und studiert berufsbegleitend Informationsmanagement an der Hochschule Hannover.

Der Autor Jan Heinemeyer arbeitet derzeit in der Stadtbücherei Penzberg und studiert berufsbegleitend Informationsmanagement an der Hochschule Hannover.

Beide Autoren eint das private Interesse an Informatik, Gaming, KI und Brettspielen.

1: Bastian, Matthias (2022)

2: DeepMind (2023)

3: Perolat, Julien u.a. (2023)

4: Meier, Christian J. (2022)

5: Menge-Sonnentag, Rainald (2022)

6: Schreiner, Maximilian (2020)

7: Perolat, Julien u.a. (2022)

Bastian, Matthias (2022): Deepminds neue Spiele-KI soll ein Game-Changer in der echten Welt werden. . In: THE-DECODER.de, Ausgabe vom 04.12.2020. Online verfügbar unter https://the-decoder.de/deepminds-neue-spiele-ki-soll-ein-game-changer-in-der-echten-welt-werden/, zuletzt geprüft am 05.01.2023.

DeepMind (2023): DeepNash Stratego game 1. Online verfügbar unter https://www.youtube.com/watch?v=HaUdWoSMjSY, zuletzt aktualisiert am 05.01.2023, zuletzt geprüft am 05.01.2023.

Meier, Christian J. (2022): Künstliche Intelligenz spielt Stratego und besiegt Menschen: ein Durchbruch. In: Süddeutsche Zeitung, 02.12.2022. Online verfügbar unter https://www.sueddeutsche.de/wissen/kuenstliche-intelligenz-stratego-brettspiel-durchbruch-menschen-1.5707877, zuletzt geprüft am 05.01.2023.

Menge-Sonnentag, Rainald (2022): KI meistert nächstes komplexes Brettspiel: DeepNash siegt in Stratego. In: heise online, 05.12.2022. Online verfügbar unter https://www.heise.de/news/KI-meistert-naechstes-komplexes-Brettspiel-DeepNash-siegt-in-Stratego-7365933.html, zuletzt geprüft am 05.01.2023.

Perolat, Julien u.a. (2022): Mastering the Game of Stratego with Model-Free Multiagent Reinforcement Learning. Online unter https://arxiv.org/pdf/2206.15378.pdf [Abruf am 07.01.2023]

Perolat, Julien u.a. (2023): Mastering Stratego, the classic game of imperfect information. Online verfügbar unter https://www.deepmind.com/blog/mastering-stratego-the-classic-game-of-imperfect-information, zuletzt aktualisiert am 05.01.2023, zuletzt geprüft am 05.01.2023.

Schreiner, Maximilian (2020): Deepmind MuZero: Auf dem Weg zum Universalalgorithmus. In: THE-DECODER.de, Ausgabe vom 24.12.2020. Online unter https://the-decoder.de/deepmind-muzero-auf-dem-weg-zum-universalalgorithmus/#top, zuletzt geprüft am 05.01.2023.

Autorinnen: Jennifer Tews und Katharina Trommer

Die Kundschaft ist König – doch was erwartet sie eigentlich? Was erwarten Kund:innen von einem Produkt oder einer Dienstleistung und womit lassen sie sich begeistern? Für Unternehmen oder Dienstleister ist es wichtig, die Bedürfnisse seiner Kund:innen sowie deren Ansprüche und Wünsche zu kennen und im besten Fall zu erfüllen. Denn nur so können eine erhöhte Nachfrage und ein dementsprechendes Angebot gewährleistet werden. Eine Einführung in diese Thematik sowie das Kano-Modell als Methode, die Zufriedenheit der Kund:innen festzustellen, erhalten Sie in diesem Beitrag.

Ob Parkautomat oder Selbstbedienungskasse im Supermarkt – unser Alltag ist von interaktiven Produkten und Anwendungen geprägt. Dabei kommt es vor, dass wir mit einigen Systemen mühelos zurechtkommen und uns mit anderen schwertun. Dementsprechend hinterlassen Produkte oder Anwendungen einen positiven, geradezu großartigen Eindruck oder einen negativen und unbefriedigenden. Diese Erfahrung lässt sich in einem einfachen Begriff beschreiben: User Experience (kurz UX).[1]

Die User Experience beschreibt die Wahrnehmungen und Reaktionen einer Person auf die Nutzung eines Systems, Produktes oder einer Dienstleistung.[2] Sie rückt das subjektive Empfinden sowie die Bedürfnisbefriedigung der Nutzenden ins Zentrum, wobei emotionale Faktoren handlungsleitend sind. Ein positiv in Erinnerung gebliebenes Nutzungserlebnis kann dafür sorgen, dass Kund:innen ein Produkt weiterempfehlen oder noch einmal kaufen. Insbesondere die Ästhetik und intuitive Anwendbarkeit wirken dabei überzeugend.[3]

„Wenn sie ein großartiges Erlebnis schaffen, werden sich die Kund:innen gegenseitig davon erzählen. Sie müssen immer fantastisch sein.“

Jeff Bezos, Amazon

Einfach gesagt entscheiden sich Kund:innen beim Kauf für das Angebot, welches ihren Anforderungen und Wünschen am meisten entspricht. Für Unternehmen ist es daher sinnvoll, die Aspekte der User Experience zu berücksichtigen, um die Nutzungszufriedenheit zu steigern und eine positive Wahrnehmung des Produktes zu bewirken. Dies erfordert mitunter, sich von etablierten Praktiken bei der Produktentwicklung zu lösen und neue Wege einzuschlagen, um Produkte und Anwendungen noch besser an die Bedürfnisse der Nutzer:innen anzupassen.

Damit landen wir wieder bei unserer Einstiegsfrage, was Kund:innen erwarten? Um herauszufinden, womit Produkte und Dienstleistungen positive Eindrücke hinterlassen, ist die Analyse der Zufriedenheit der Kundschaft notwendig.

Das Kano-Modell ist eine Methode, um die Zusammenhänge zwischen dem Erreichen bestimmter Produkt-oder Dienstleistungseigenschaften und der erwarteten Kund:innenenzufriedenheit darzustellen. Der Schöpfer dieses Modells, Noriaki Kano, bezieht sich bei seinem Modell auf die Theorie von Frederick Herzberg. Diese besagt, dass nicht notwendigerweise ein linearer Zusammenhang zwischen der Erfüllung eines Bedürfnisses und der daraus resultierenden Zufriedenheit bzw. Unzufriedenheit bestehen muss.[4]

Innerhalb des Kano-Modells wird zwischen verschiedenen Anforderungskategorien, auch Merkmale oder Faktoren genannt, unterschieden. Es gibt Basis-, Leistungs- und Begeisterungsfaktoren. In einigen Darstellungen wird das Modell durch Questionable, Indifferente Merkmale und Reverse Merkmale ergänzt. Alle Kategorien unterscheiden sich in ihrem Einfluss auf die Kund:innenzufriedenheit und werden im Vorfeld häufig mittels Interviewverfahren bestimmt. Um im Anschluss die Produkt- oder Dienstleistungsanforderungen den einzelnen Kategorien zuordnen zu können, werden Kund:innenenreaktionen bewertet. Dabei wird ein Fragetechnik angewendet, welches auf der Beantwortung zweier Fragen beruht – der funktionalen und der dysfunktionalen Frage.[4]

Die funktionale Frage ist positiv formuliert und bezieht sich auf die Reaktion der Kund:innen, wenn ein Produkt die jeweils abgefragte Eigenschaft besitzt.

Zum Beispiel:

Was würden Sie sagen, wenn das Produkt bzw. die Dienstleistung über das Merkmal XY verfügen würde?

Die dysfunktionale Frage ist negativ formuliert und bezieht sich auf die Reaktion der Kund:innen, wenn diese Eigenschaft nicht vorhanden ist.

Zum Beispiel:

Was würden Sie sagen, wenn das Produkt bzw. die Dienstleistung NICHT über das Merkmal XY verfügen würde?

Basisfaktoren umfassen Eigenschaften, die von der Kundschaft als Muss für das Produkt vorausgesetzt, aber nicht explizit gefordert werden. Aus diesem Grund werden sie als „Basic“ oder „Must-Be“ bezeichnet. Da diese Faktoren als selbstverständlich erachtet werden, wirkt sich ihr Vorhandensein nicht positiv auf die Kund:innenzufriedenheit aus. Umgekehrt führt ihr Fehlen zu starker Unzufriedenheit.

Ein Beispiel dafür wären die Räder eines Fahrzeugs.

Anders verhält es sich mit den Leistungsfaktoren. Die Zufriedenheit der Kundschaft wächst proportional zum Erfüllungsgrad dieser Anforderungen. Je mehr ein Leistungsattribut erfüllt ist, desto positiver wirkt es sich auf die Kund:innenzufriedenheit aus und umgekehrt. Leistungsfaktoren fungieren häufig als Vergleichskriterium unterschiedlicher Produkte, Angebote oder Dienstleistungen und werden explizit von Kund:innen erwartet.

Ein Beispiel wäre ein Automotor mit besonders starker Leistung.

Begeisterungsfaktoren haben den größten Einfluss auf die Zufriedenheit der Kundschaft. Sie übersteigen deren Anforderungen, sorgen für Begeisterung und werden, ebenso wie die Basisfaktoren, nicht explizit von der Kundschaft verlangt. Im Gegensatz zu den Basisfaktoren werden sie aber nicht vorausgesetzt und lösen deswegen keine Unzufriedenheit aus, wenn sie nicht vorhanden sind. Durch Begeisterungsfaktoren können sich Produkte und Dienstleistungen deutlich von der Konkurrenz abheben. Bereits kleine Leistungssteigerungen können zu einer überproportionalen Steigerung der Kund:innenzufriedenheit führen. Allerdings sind Begeisterungsfaktoren nur schwer zu ermitteln.

Ein Begeisterungsfaktor im Auto könnte eine Sitzheizung sein.

Als ergänzende Faktoren können auch Questionable, sowie Indifferente und Reverse Merkmale betrachtet werden.

Questionable weisen auf unlogische Antworten hin und treten auf, wenn sowohl die funktionale Frage als auch die dysfunktionale Frage positiv beziehungsweise negativ beantwortet werden.

Ein Beispiel ist die positive Einschätzung eines sowohl hohen als auch geringen Kraftstoffverbrauchs eines Autos.

Indifferente Merkmale spielen für das Kano-Modell lediglich eine untergeordnete Rolle, da das Vorhandensein oder Fehlen dieser Attribute weder positive noch negative Auswirkungen auf die Nutzungszufriedenheit hat.

Es macht beispielsweise keinen Unterschied, ob das Gaspedal eines Fahrzeugs blau oder schwarz ist.

Bei Reversen Merkmalen sorgt ein hoher Erfüllungsgrad für Unzufriedenheit bei der Kundschaft. Ein nicht Erfüllen der Attribute führt häufig, aber nicht zwangsläufig zu einer Steigerung der Kund:innenzufriedenheit.

Autos mit besonders viel Hightech und Elektronik können auch Unzufriedenheit auslösen, da beispielsweise die Bedienung als zu kompliziert empfunden wird.[5], [6]

Wer weiß, was die Kund:innen begeistert, kann Features bewusst einsetzen, um einen Wettbewerbsvorteil zu erlangen oder die Qualität des Produktes zu verbessern. Zudem lassen sich durch die Steigerung der User Experience unternehmerische Ziele als auch die Interessen der Kundschaft kombinieren. Das Kano-Modell ist eine geeignete Methode, um neue Konzepte, Ideen und Features zu testen und zu bewerten. Zusätzlich vermittelt es ein umfassendes Verständnis für die verschiedenen Anforderungen der Kundschaft, indem es das Verhältnis zwischen Produktanforderung und Kund:innenzufriedenheit abbildet. Kurz gesagt: durch das Kano-Modell lernen Sie die Wünsche und Ansprüche Ihrer Kund:innen kennen, welche sie gewinnbringend für die Verbesserung der User Experience Ihrer Produkte und Dienstleistungen einsetzen können.[7], [8]

Sie wollen gleich loslegen und die Zufriedenheit Ihrer Kundschaft mittels Kano-Modell herausfinden? Wir haben Ihnen eine kleine Übersicht mit weiterführenden Informationen zusammengestellt.

Autor: Hendrik Kuck

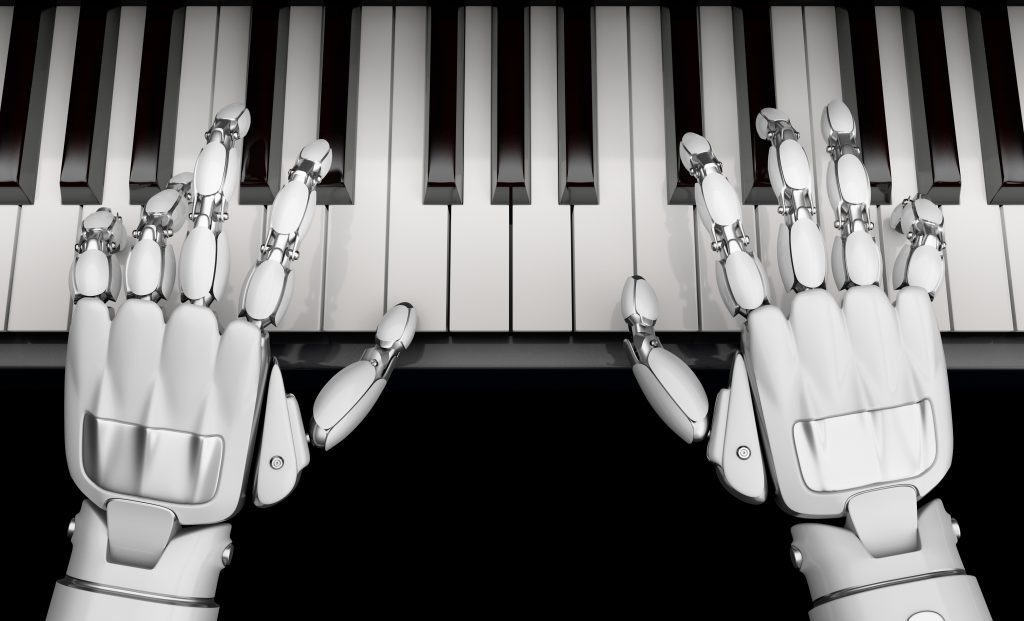

Komponieren mithilfe von Künstlicher Intelligenz? Zukunftsmusik oder bereits Alltag in der Musikbranche? Wie funktioniert so etwas? Und wer profitiert davon? Mögliche Antworten liefert der folgende Artikel zum Thema „Künstliche Intelligenz in der Musikkomposition“.

Künstliche Intelligenz nimmt in unserer Gesellschaft eine immer zentralere Rolle ein. Sie ist aus Wirtschaft, Medien und Technik nicht mehr wegzudenken und wird in Deutschland u.a. von der Bundesregierung gefördert.1 Auch die Musikbranche wird nachhaltig von KI geprägt und Künstliche Intelligenz befindet sich besonders in der Musikkomposition auf dem Vormarsch.2 Besonders die Komposition von Hintergrundmusik für Social Media, Werbung und Gaming wird in Zukunft von ihr dominiert.3 Aber wie funktioniert das Komponieren von Musik mithilfe von KI eigentlich? Wer arbeitet mit ihr? Steht sie in einem ethischen Konflikt mit menschlichen Musikern und Komponisten und kann sie überhaupt wirkliche Kunst erschaffen? Diesen Fragen widmet sich der folgende Artikel.

Damit eine KI Musik komponieren kann, muss sie zunächst für diesen Einsatzzweck trainiert werden. Sogenannte „Neuronale Netzwerke“ lernen anhand großer Datenmengen (Big Data) die Struktur und Elemente vorhandener Musik. Durch ständige Analyse wird sie immer besser darin, Muster im Songaufbau zu erkennen und ist zu beachtlichen analytischen Leistungen in der Lage.4 Allerdings ist die derart entstandene Musik ohne menschliche Bearbeitung eher Mittelmaß. Das Verfassen von Songtexten und Einspielen der Instrumente sollte daher durch menschliche Hand erfolgen. 5 Künstliche Intelligenz ist deshalb eher als Werkzeug, welches die kompositorische Arbeit erleichtert, zu betrachten.6

Klicken Sie auf die folgende Abbildung, um selbst mit dem Komponieren loszulegen und kreieren Sie mithilfe der KI von Soundraw eigene Songs.

Die Umsetzung computergenerierter Kompositionen ist bereits Realität. Beispielsweise erschuf der Wissenschaftler David Cope mithilfe von KI Werke klassischer Musik, welche Vivaldi, Bach oder Chopin ähneln. Die Aufführung mit einem echten Orchester konnte sogar Fachpublikum täuschen.7 Weiterhin konnten Forscher ein neuronales Netzwerk mithilfe von 45 Songs der Beatles so lange trainieren, bis es ein eigenes Stück entwarf, welches auffällig stark dem Ursprungsmaterial ähnelte. Lediglich der Text zu dem Song „Daddy’s Car“ musste von Menschen geschrieben werden.8

Auch private Nutzer können KI zur Musikkomposition nutzen. So bietet das Berliner Unternehmen „Loudly“ auf ihrer Homepage eine eigens mit ca. zehn Millionen Songs trainierte KI an. Nutzer können somit schnell eigene Lieder generieren lassen. Sie wählen lediglich Genre, Songlänge und Instrumente aus, den Rest übernimmt die KI.9 Auch professionelle Künstler haben sich bereits auf die Zusammenarbeit mit Künstlicher Intelligenz beim Kreieren von Songs spezialisiert. Die Berlinerin Holly Herndon hat auf diese Weise bereits mehrere Alben veröffentlicht.10

Mit der zunehmenden Verbreitung von Künstlicher Intelligenz in der Musikbranche treten auch vermehrt ethische Fragen auf. Verdrängt die Maschine den Menschen? Ist computergenerierte Musik überhaupt Kunst?

Dr. Ralf Weigand, Vizepräsident des Deutschen Komponistenverbandes und Vorsitzender des Aufsichtsrats der GEMA, sieht KI in der Musik mit potenziellen Nachteilen verbunden. Besonders im Bereich der Gebrauchsmusik (Hintergrundmusik für Film, Fernsehen, Social Media etc.) könne KI eine Gefahr für die Jobs der Musikschaffenden bedeuten. Zudem sorge eine Überflutung des Musikmarkts mit computergenerierter Musik eventuell dafür, dass Menschen diese Musik nicht mehr von menschengemachter unterscheiden könnten.11

Rory Kenny, Gründer des eingangs erwähnten Unternehmens „Loudly“, hält dagegen. KI schaffe bereits neue Jobs wie Softwareentwickler oder Informationsspezialisten in der Musikbranche. Weiterhin ermögliche sie auch Menschen ohne Know-how die einfache und zugängliche Produktion von Musik.12

„Das wird eine sehr interessante weitere Demokratisierung des Musikschaffens.“

Rory Kenny13

Auch professionelle Kunstschaffende könnten Vorteile aus der Kooperation mit KI ziehen und Gefallen daran finden.14 Ein Beispiel hierfür ist die bereits erwähnte Holly Herndon.

Auch ob Künstliche Intelligenz wahrhaftige Kunst erschaffen kann, ist umstritten. Der Neurowissenschaftler Matthias Bethge sieht KI zwar eher als Werkzeug, spricht ihr allerdings alle Merkmale menschlicher Kreativität zu. Genau wie der Mensch würde sie zunächst Erfahrungen sammeln und Strukturen analysieren, um dann auf dieser Basis etwas Neues zu schaffen. Hans-Christian Ziupa, Gewinner des KI-Musik-Wettbewerbs „Beats & Bits“, sieht jedoch einen zentralen Unterschied zwischen Mensch und KI. Zuhörer würden von Musikern erwarten, dass sie bei der Schöpfung von etwas Neuem mit sich gerungen und dabei eine gewisse emotionale Radikalität entwickelt hätten. Dies sei einer KI nicht möglich.15

Rory Kenny glaubt ebenfalls nicht an den Ersatz menschlicher Musiker durch Maschinen. Musik sei im Kern Storytelling, KI sei jedoch nicht in der Lage Geschichten zu erzählen.16 Goetz Richter, Musiker und Professor der Universität Sydney, sieht KI zudem als abhängig von Menschen und ihren Anweisungen. Es sei komplett verschieden, ob aus bereits bestehenden Werken Eigenschaften abstrahiert, oder schöpferische Werke erschaffen würden. Zu Letzterem sei KI nicht in der Lage. Musik sei kein Ergebnis reiner Analytik, sondern erfordere Neugier, Sinnfindung, Bewusstsein, gelebte Erfahrung, Aufmerksamkeit und Empathie. Dies seien alles Eigenschaften, welche Computern fehlen würden.17 Renate Buschmann, Professorin für digitale Künste der Universität Witten/Herdecke, sieht dies ähnlich. KI habe ihre Stärke im Analysieren von Mustern und dem Kopieren. Kunst sei aber eben das Brechen von Regeln und dem Erschaffen von Unberechenbarkeit.18

Eine weitere komplexe Frage in diesem Kontext ist die, nach der rechtlichen Urheberschaft künstlich komponierter digitaler Produktionen. Sowohl Nutzer der KI (Wahl der Schlagworte bei der Generierung), Künstler (Rahmen und Konzept auf welches KI zugreift), Programmierer (Entwicklung der Software) als auch die Maschine selbst (Komposition des Werkes) kommen als mögliche Urheber infrage.19 Nicht nur diese, sondern auch die oben angesprochenen Themen, werden die Musikbranche in Zukunft mit Sicherheit prägen und beschäftigen.

1 vgl. Die Bundesregierung 2020

2 vgl. Bora 2021

3 vgl. Die Bundesregierung 2020

4 vgl. Bora 2021, Die Bundesregierung 2020 und Richter

5 vgl. Die Bundesregierung 2020

6 vgl. Bora 2021

7 vgl. Richter

8 vgl. Die Bundesregierung 2020

9 vgl. Bora 2021

10 vgl. Die Bundesregierung 2020

11 vgl. Bora 2021

12 vgl. Bora 2021

13 Bora 2021

14 vgl. Buschmann 2022, S.165

15 vgl. Die Bundesregierung 2020

16 vgl. Bora 2021

17 vgl. Richter

18 vgl. Buschmann 2022, S.164-165

19 vgl. Buschmann 2022, S.169

Bora, Tereza (2021): Kreative KI. Künstliche Intelligenz verändert die Musikbranche. Online unter [Abruf am 23.11.2022]

Buschmann, Renate (2022): Kann aus KI Kunst werden?. Dialogische Beziehungen mit Künstlicher Intelligenz. In: Schnell, Martin W.; Nehlsen, Lukas (Hg.): Begegnungen mit Künstlicher Intelligenz. Intersubjektivität, Technik, Lebenswelt. Weilerswist: Velbrück Wissenschaft, S. 164-173. Online unter: doi.org/10.5771/9783748934493

Die Bundesregierung (2020): KI spielt die Musik. Online unter https://www.bundesregierung.de/breg-de/suche/ki-in-der-kultur-1720970 [Abruf am 23.11.2022]

Richter, Goetz (o.J.): Die scheinbare Originalität von KI-Musik. Online unter https://www.goethe.de/prj/k40/de/mus/aim.html [Abruf am 23.11.2022]

Der Autor Hendrik Kuck arbeitet an der Universitätsbibliothek Osnabrück und studiert zurzeit berufsbegleitend Informationsmanagement an der Hochschule Hannover