Autor: Philippe Paszkier

Wir alle kennen es, man spricht mit einem Freund oder Partner über irgendein Produkt o.ä. ohne dabei überhaupt das Handy entsperrt zu haben und dann möchte man etwas googeln und die Werbung handelt von dem eben besprochenen Thema. Ich meine klar, hat so seine Vorteile da weiter machen zu können, wo die Unterhaltung aufgehört hat. Aber ist das nicht eigentlich ein bisschen unheimlich, dass dir dein Smartphone immer zuhört und alles mitbekommt, was man in dessen Umgebung sagt? Passieren tut das durch Big Data.

Was ist denn eigentlich Big Data?

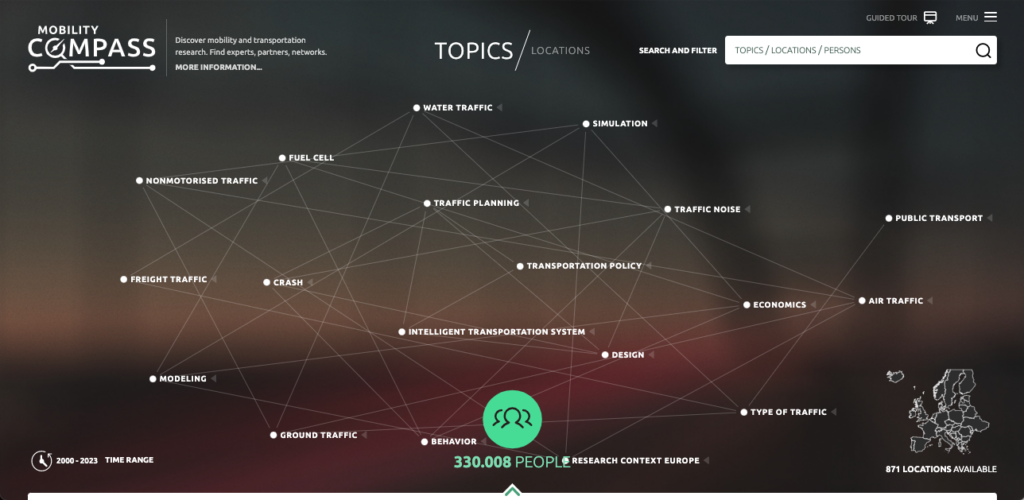

Der Begriff Big Data beschreibt eine große Masse an personenbezogenen Daten, die Unternehmen wegen ihrer Schnelllebigkeit und Komplexität zu Analysezwecken nutzen. Unter den Begriff fallen unter anderem Daten in Form von Zahlen, Texten, Standortverläufen, Videos, Zahlungsunterlagen, Bilder oder auch das gesprochene Wort.

3V-Modell

Der Branchenanalytiker Douglas Laney beschrieb Big Data mit dem 3V-Modell. Das erste V steht für Velocity, also die Geschwindigkeit, mit der neuen Daten ankommen und man diese verarbeiten muss. Dann gibt es noch das Volume, also die gesamte Masse an Daten aus den unterschiedlichsten Quellen. Als drittes V gibt es Variety, welches die Vielfalt der Formen der gesammelten Daten beschreibt. Aber im Laufe der Zeit kamen weitere Vs dazu. So auch das V für Variability, also der Schwankung des Datenflusses und Form der Daten. Des Weiteren gibt es noch Veracity, was die Richtigkeit der Daten beschreibt und diese einordnet und sortiert. Je nachdem wo man schaut, gibt es noch die Kategorie Value. Diese beschreibt den Geschäftswert der Daten.

Speicherung

Anfang der 2000er fand der Begriff Big Data das erste Mal Einzug in die Köpfe der Menschen. Da fing nämlich die Speicherung und Interpretation von Daten aus dem Internet an. Damals ging es noch eher um das Klickverhalten auf der eigenen Webseite oder die IP-Adresse des Kunden. Von damals zu heute hat sich aber einiges getan, die Form der Daten hat sich geändert und natürlich auch die Datenmenge. Allein im Jahr 2012 wurden weltweit 6,5 Zettabyte an Daten gesammelt. Was ist ein Zettabyte, fragt ihr euch jetzt? Ein Zettabyte steht für EINE MILLIARDE TERRABYTE. Im Jahr 2020 waren es dann auch schon 64,2 Zettabyte. Das bedeutet, dass jeder Mensch, der irgendwie mit dem Internet verbunden ist, durchschnittlich tagtäglich ca. 150 Gigabyte an persönlichen Daten übermittelt. Um sich das mal auf der Zunge zergehen zu lassen, der Film Titanic aus dem Jahr 1997, der wohlgemerkt über drei Stunden läuft, verbraucht in HD einen Speicherplatz von 8,5 Gigabyte.

Zweck

Diese unfassbar riesige Menge an Daten wird für Unternehmen interessant, da diese dadurch Zeit in der Entwicklung neuer Produkte und Dienstleistungen einsparen. So analysiert man Trends um zu prüfen, wo es noch Marktlücken gibt. Ein offensichtlicher Vorteil der Big Data Analyse ist auch die personalisierte Werbung. Der Algorithmus weiß, wie man einen am besten anspricht und wofür man sich interessiert, vielleicht sogar besser als man selbst. Des Weiteren können klügere geschäftliche Entscheidungen getroffen werden, da man durch die Echtzeitanalyse, Veränderungen und Unsicherheiten bewerten und dementsprechend handeln kann. Zudem kann die Produktion effizienter gestaltet werden, da der Kunde einem sagt, was man braucht, wenn auch unfreiwillig. Das Gesprochene und geschriebene Wort, so wie Chats oder Sprachnachrichten, wird zum Füttern von Deep Learning KIs genutzt, um die maschinelle Art des Schreibens und Sprechens zu optimieren und menschlicher/natürlicher machen zu können.

Weitere Orte an denen Daten über einen gesammelt werden sind Autos die mit dem Handy und mit dem Internet verbunden sind. Außerdem auch Bankdaten, Smart-Home Gadgets und ihre Assistenten wie bpsw. Alexa oder halt klassische Überwachungsmaßnahmen.

Aufschrei Big Data

Facebook Skandal

Erinnert ihr euch noch ans Jahr 2018? Bevor die Pandemie über uns hereinbrach, brach etwas anderes zusammen. Die Reputation von Facebook. Damals kam nämlich raus, dass Facebook (Meta) Daten von mindestens 87 Millionen Nutzern durch Camebridge Analytica (C.A.) auswerten ließ, um so illegal Werbung für den Trump-Wahlkampf zu machen. Die Muttergesellschaft von C.A., die SCL-Group hat es sich zum Geschäftsmodell gemacht, politische Wahlen und Stimmungen durch Big Data Auswertung zu beeinflussen.

Auswertung

Big Data ist aber nicht nur für Meta ein Geschäftsmodell. Google und TikTok machen nichts anders. Es wird alles gespeichert, von der Sucheingabe (was suchst du, wie suchst du es, was schreibst du, welche Wörter nutzt du) bis zurzeit, die du brauchst um dich für ein Ergebnis zu entscheiden. Was klickst du auf der Seite an? Wie lange bist du auf der Seite unterwegs? Wo geht es nach dem Besuch der Webseite hin? Wie schnellt scrollst du weiter? Welche Webseiten besuchen deine Freunde und Familie? All das wissen die Unternehmen wie C.A. schon bevor du selbst irgendwas gemacht hast. Jeder Schritt wird verfolgt, jede neue Suche, jede Meinungsänderung wird wahrgenommen. Man wird komplett durchleuchtet.

Social-Credit-Score

Kleiner Funfact am Rande, wusstest du, dass Big Data der Grundbaustein für den Social-Credit-Score in China ist? So wird genau erkannt, wo du wie viel reininvestiert, was du mit deinem Alipay Account bezahlt und ob du dein Leihfahrrad auch wieder am richtigen Ort abgestellt hast. Das in Verbindung mit ausgereifter Gesichtserkennungssoftware an öffentlichen Plätzen und du bist durchsichtig. Dadurch, dass heutzutage alles miteinander verbunden ist und alles einfacher werden soll, wird auch vieles noch komplizierter. So auch das Profil was Meta über Nicht-Nutzer anlegen kann, welches auf Daten basiert, die von Bekannten irgendwie irgendwo gespeichert worden sind und die Organisation Zugriff drauf hat.

Wert

Es gibt noch ewig viele Beispiele, was mit Big Data überall auf der Welt gemacht wird und wie man mehr und mehr die Entscheidungsgewalt über sich selbst abgibt. Aber eine Frage ist noch interessant, auf die ich noch nicht eingegangen bin. Wie viel sind diese Daten eigentlich Wert? Auch wenn man Big Data als das Erdöl der digitalen Wirtschaft bezeichnet, kann ich hier leider keine sichere Zahl nennen. Aber ich möchte nur so viel sagen, dass die E-Scooter, die man überall in der Stadt sieht, mit einer durchschnittlichen Lebensdauer von wenigen Monaten, so viele Daten über uns sammeln, dass die Unternehmen locker an die Börse gehen können. Und das nur durch den Verkauf der gesammelten Daten.

Emissionen

Ach so, ganz vergessen. Diese Zettabyte an Daten, die anfallen, müssen irgendwo gespeichert werden. Und wo macht man das? Genau. In riesigen Rechenzentren, die weltweit im Jahr 2020 zwischen 100 und 500 Millionen Tonnen CO2 ausgestoßen haben. Und das Problem hierbei ist, dass es nur noch mehr wird. Es werden mehr Menschen -> mehr Menschen, die einen Internetzugang haben -> mehr Daten -> mehr Server -> mehr Rechenzentren -> mehr CO2. Aus einer ARTE Dokumentation habe ich entnommen, dass im Jahr 2025 geschätzt wird, dass 25 % des gesamten Energieverbrauches nur auf Rechenzentren zurückzuführen sind.

Die Datenschutzgrundverordnung (DSGVO)

Doch wie sieht das Ganze in der Europäischen Union aus? Was für Vorgaben gibt es hier?

In der EU wurde im Jahr 2016 die DSGVO eingeführt. Die erste Datenschutzbestimmung kam aus dem Jahr 1995, als das Internet noch lange nicht den Umfang angenommen hat wie heute. Die DSGVO soll somit alle datenschutzrechtlichen Themen und Rechte aus den unterschiedlichen Mitgliedsstaaten für die gesamte EU festhalten. Der Grund für die Einführung der neuen Verordnung ist, dass Unternehmen einen festen Fahrplan brauchen, wie sie mit den personalisierten Daten umzugehen haben, um nicht das Persönlichkeitsrecht der Nutzer und Besucher zu verletzen. Folgende Grundlagen werden deshalb in der DSGVO festgehalten:

- Rechtmäßigkeit (Ob die Daten verarbeitet werden dürfen/ wenn ja wie)

- Transparenz (welche Daten werden verarbeitet)

- Zweckbindung (nur für bestimmten Zweck)

- Speicherbegrenzung (Daten müssen gelöscht werden, wenn irrelevant oder gewollt)

- Richtigkeit (keine falschen Daten verwenden)

- Datenminimierung (Menge für Zweck angemessen)

- Integrität und Vertraulichkeit (Schutz vor unfreiwilliger Weitergabe)

- Rechenschaftspflicht (Dokumentation des Verarbeitungsprozesses)

direkter Widerspruch

Das Problem hierbei ist jedoch, dass Big Data ein Sammelbegriff für solche Daten ist. Somit ist festzuhalten, dass Big Data an sich gar nicht den Prinzip der Datenminimierung einhalten kann. Big Data sammelt nicht nach einem Zweck, sondern die Daten an sich bestimmen zu welchem Zweck sie dienen. Vergleichbar ist das mit der Vorratsdatenspeicherung, die hierzulande für Aufsehen gesorgt hatte, da diese ab 2015 gegen das EU-Recht verstoßen hat. Big Data ist das, nur in noch größer… Die einzige Ausnahme sind Kinder, denn ihre Daten dürfen nicht analysiert werden. Da frage ich mich nur, woher wissen die denn, ob es sich um ein Kind handelt?

Witzige finde ich persönlich ja auch, dass in der DSGVO der Begriff Big Data unter dem Punkt Profiling fällt. Allein dieses Wort beschreibt die Existenzgrundlage der Big Data. Man versucht damit ein Bild oder Profil des Nutzers zu schaffen, mit all seinen guten und schlechten Seiten, Kreditwürdigkeit, Essgewohnheiten und alles was zum Leben dazugehört. Sozusagen ein Freundebuch, nur dass wir keine Freunde sind, sondern ein Stalkingopfer, ohne uns darüber bewusst zu sein.

Positive Entwicklung

Aber es muss trotzdem festgehalten werden, dass die restlichen Maßnahmen einen ernsthaften Unterschied im Umgang mit unseren Daten ausmachen. So wird beispielsweise die Dokumentation des Verarbeitungsprozesses eine besonders wichtige Aufgabe, denn dadurch kann nachvollzogen werden, was ausgewertet worden ist und ob das Unternehmen die Analyse solcher Daten valide begründen kann. Außerdem muss eine Risikoanalyse der Datenverarbeitung entwickelt werden und aufgefallene Risiken an die dafür zuständige Aufsichtsbehörde weitergeleitet werden. Einen weiteren positiven Faktor bringt die DSGVO noch mit sich. Dadurch, dass die Datenschutzproblematik mitten in der Öffentlichkeit steht, werden die unterschiedlichen Umgänge mit personenbezogenen Daten ein durchaus wichtiger Wettbewerbsfaktor für viele Unternehmen. Aber nur für die Unternehmen innerhalb der EU. Im EU-Ausland sieht das ganze anders aus.

Eine Expertenmeinung

Die Expertin ist Prof. Yvonne Hofstetter. Sie ist Autorin, Juristin und Essayistin, welche in Softwareunternehmen tätig ist und sich um die „Positionierung von Multi-Agentensystemen bei der Rüstungsindustrie und für den algorithmischen Börsenhandel“ kümmert, schilderte in einem Vortrag vom YouTube-Kanal BildungsTV aus dem Jahr 2014, wie das Geschäft mit Big Data funktioniert. So beschreibt sie unter anderem, dass der Finanzmarkt durch die Auswertung jeglicher verfügbaren Informationen, dem Militärsektor sehr ähnelt. So funktioniert der teilweise illegale Hochfrequenzhandel, bei dem Händler und Banken zusammenarbeiten, um dem Investor die Aktien möglichst teuer, weiterzuverkaufen. Auch Aktienpreise werden durch Algorithmen, die durch Unmengen an Finanzdaten gefüttert werden, gedrückt bzw. manipuliert. Außerdem zeigt sie das Ziel der Big Data Analyse im Wirtschaftssektor auf, welches ist, den Menschen zu manipulieren.

Das Beispiel

Der Wirtschaftlicher Erfolg ist nicht der einzige Zweck der durch Verarbeitung großer Datenmengen verfolgt wird. So habe sie einst an einem Projekt dem LKA Bayern mitgeholfen, bei dem man überprüfen wollte, ob sich der Drogenhandel von der einen Stadt in die andere verlegt hat. Dafür wurde ausgewertet, welche Delikte begangen worden sind, wer mit wem im Gefängnis saß, wer mit wem verwandt ist oder wer mit wem schonmal etwas zu tun hatte. Durch diese Analyse wurde dann klar, dass sich sowohl die Gruppierung, verantwortlich für den Drogenhandel geändert hatte, als auch Informationen über den Hintermann. Problematisch ist es nur dann geworden, als die Vorstrafen des Mannes gelöscht worden sind, jedoch das Wissen der Hintermann-Tätigkeit noch immer bestand. Das LKA entschied sich dann für den Datenschutz und das Löschen dieser Informationen, nachdem das Löschdatum von einem Rohdatensatz überschritten worden war.

Das Problem

Frau Professor Yvonne Hofstetter sieht das große Problem darin, dass die Technik, die zur Überwachung von Personen einst nur dem Militär zur Verfügung stand, jetzt auch im Privatsektor zu finden ist. Aber der Zweck ist kein anderer. So sagt sie unter anderem: „Wir, wir sind die Ursache für riesige Milliardengewinne bei Google oder Facebook, aber wir kriegen nichts dafür. Wir werden wie ich gerade gesagt habe, ausgebeutet.“

Forderungen

So fordert sie zu einem das Recht auf Gegenleistung für die eigenen Daten. Zudem ein Recht der Kontrolle und die damit verbundene Löschung der Daten. Zuletzt das Recht auf negative Freiheit, was so viel heißt wie, dass man keinen Nachteil durch die Nicht-Nutzung von digitalen Technologien erleidet. Diese Punkte wurden zum Teil in der DSGVO von 2018 umgesetzt und zu EU-Recht gemacht. So beispielsweise das Fenster, in dem man seine Cookies bestimmen kann.

Fazit

Nun denn, was halten wir nun von Big Data? Big Data hat sowohl Vorteile als auch massive Nachteile. Die Analyse der Daten hat zur Folge, dass zukünftige Ereignisse vorhergesagt werden oder bessere Entscheidungen getroffen werden können. Prozesse und Lieferketten können optimiert werden. Werbung wird immer besser die Zielgruppe ansprechen und Dinge über die man gerade gesprochen hat, schon als Werbung angezeigt bekommen. Irgendwie entsteht das digitale Abbild eines Selbst. Nur kommt man hier wieder zu dem unausweichlichen Kritikpunkt, dass der Mensch zum Produkt gemacht wird und eigentlich nichts von der Analyse der eigenen Daten hat. Der Mensch wird manipuliert und unterbewusst zu Entscheidungen gezwungen. Klar sollte sein, dass das eine kritische Entwicklung des Kapitalismus ist. Nur nicht von staatlicher Seite, sondern von Milliardenunternehmen, die nichts mehr interessiert, als uns zu Geld zu machen. Daher, passt, auf was ihr macht. Alleine seid ihr nie.

Die Datenschutzgrundverordnung, versucht hier die Sicherheit für die Nutzer zu wahren, bzw. wiederzuerlangen. Problematisch hierbei ist jedoch, dass nur 20 % der bei einer Bitkom-Umfrage befragten Unternehmen die DSGVO komplett umsetzt. 60 % der Unternehmen sagen, dass man in Deutschland mit dem Datenschutz übertreibe. Gut 80 % der Unternehmen haben fünf Jahre nach DSGVO Verabschiedung noch immer Probleme die Vorgaben durchzusetzen. Aber zumindest haben 60 % der Befragten angeben können, zumindest den Großteil der DSGVO umsetzten zu können. Ein Schritt in die richtige Richtung. Aber fertig sind wir noch lange nicht.

Quellen

- Beitragsbild: Foto von Mika Baumeister auf Unsplash

- LTO (2022): DSGVO überfordert Unternehmen. Online unter: https://www.lto.de/recht/nachrichten/n/dsgvo-umfrage-bitcom-unternehmen-datenschutz-richtlinie-europaeische-union/ [Abgerufen am 31.01.2023]

- Fachinger, Veronika(2018): Big Data Analytics – Warum Sie diesen Trend nicht verpassen sollten und wie Sie selbst profitieren. Online unter: https://piwikpro.de/blog/was-ist-big-data-und-wie-profitieren-unternehmen-davon/ [Abgerufen am 29.11.2022]

- SAS: Big Data – Was es ist und was man darüber wissen sollte. Online unter: https://www.sas.com/de_de/insights/big-data/what-is-big-data.html [Abgerufen am 29.01.2023]

- Campbell, Charlie(2019): How China Is Using “Social Credit Scores” to Reward and Punish Its Citizens. Online unter: https://time.com/collection/davos-2019/5502592/china-social-credit-score/ [Abgerufen am 29.01.2023]

- ARTE (2022): TRACKS: Homo Data Spezial: Big Data und Datenästhetik. Online unter: https://www.youtube.com/watch?v=m6U-OhltvFw&ab_channel=IrgendwasmitARTEundKultur [Abgerufen am 29.01.2023]

- Datenschutzexperte (2017): Big Data und Datenschutz. Online unter: https://www.datenschutzexperte.de/blog/datenschutz-im-internet/big-data-und-datenschutz/ [Abgerufen am 29.11.2022]

- Hofstetter, Yvonne (2014): Big Data – Datenschutz vs. Datenschatz. Online unter: https://www.youtube.com/watch?v=jzLgCQ-hCV0&ab_channel=BildungsTV [Abgerufen am 29.01.2023]

- Statista (2021): Volumen der jährlich generierten/replizierten digitalen Datenmenge weltweit in den Jahren 2012 und 2020 und Prognose für 2025. Online unter: https://de.statista.com/statistik/daten/studie/267974/umfrage/prognose-zum-weltweit-generierten-datenvolumen/ [Abgerufen am 30.01.2023]

- Tagesschau (2018): Bis zu 87 Millionen Nutzer betroffen. Online unter: https://www.tagesschau.de/ausland/facebook-ausweitung-skandal-101.html [Abgerufen am 30.01.2023]

- Deutschlandfunk (2018): Kreis der Betroffenen könnte noch größer sein. Online unter: https://www.deutschlandfunk.de/facebook-skandal-kreis-der-betroffenen-koennte-noch-100.html [Abgerufen am 30.01.2023]

- Datenschutzgrundverordnung (DSGVO) – Was ist die DSGVO? Online unter: https://www.sumup.com/de-de/rechnungen/lexikon/dsgvo/ [Abgerufen am 30.01.2023]

- Umweltbundesamt (2022): Rechenzentren. Online unter: https://www.umweltbundesamt.de/themen/digitalisierung/gruene-informationstechnik-green-it/rechenzentren#undefined [Abgerufen am 30.01.2023]

- IHK Rhein Neckar: Die Grundsätze der Datenverarbeitung. Online unter: https://www.ihk.de/rhein-neckar/recht/datenschutz-it-sicherheit/grundsaetze-datenverarbeitung-4554126 [Abgerufen am 30.01.2023]